Bâle III et Solvabilité 2 mettent aux normes les pratiques professionnelles financières. Cette mise aux normes passe par l’utilisation d’instruments de régulation comme, par exemple, les calculs du « Best Estimate » des provisions techniques des assureurs, notion qui constitue la clé de voûte du nouveau régime prudentiel Solvabilité 2. Les règles à utiliser pour ce

Comprendre la genèse

L’importance du classement des dettes souveraines en actifs « sans risque » s’ensuit : cela permet alors à la fois leur achat par les établissements bancaires en raison de l’absence de fonds propres nécessaires à leur détention, et leur utilisation dans les évaluations des passifs des compagnies d’assurance avec les courbes de taux EIOPA. Sans même parler de la fiction de la notion de « sans risque » pour des dettes qui se sont avérées plus risquées que des obligations d’entreprises, il est remarquable de constater que les innombrables difficultés techniques rencontrées par les professionnels des banques ou des compagnies d’assurance dans l’application pratique de cette doctrine n’ont pas découragé – malgré la crise que nous connaissons aujourd’hui – les promoteurs de ces normes et de ces méthodes. La question de leur utilisation et de leur maintien est devenue un sujet presque tabou. Cette absence de débat sur les fondements conceptuels d’une doctrine aux si grands impacts professionnels, motive l’intérêt d’un retour sur son histoire : la connaissance de la genèse d’une idée est une aide pour mieux comprendre sa nature.

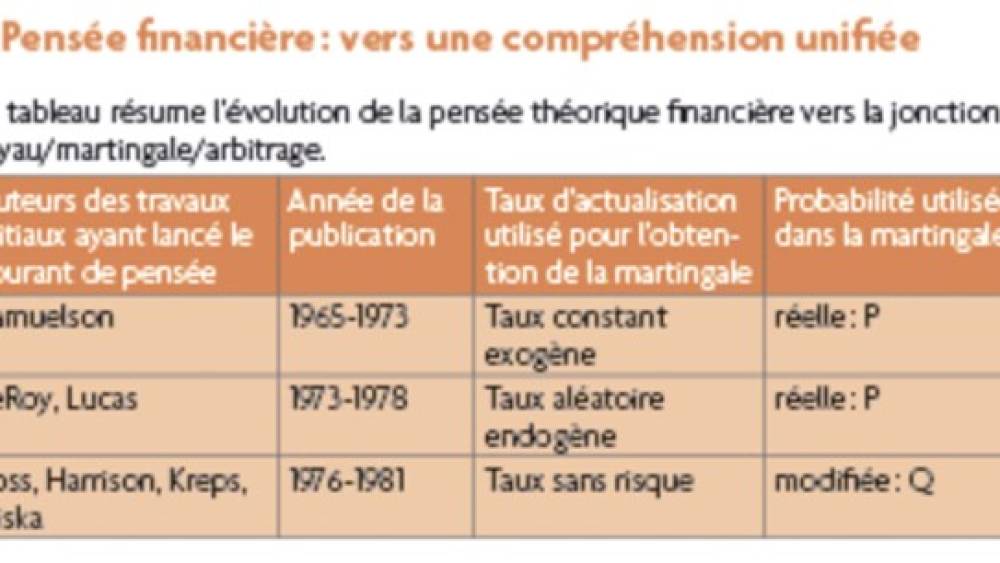

Cet article montre comment la pensée financière au XXe siècle a désenclavé les domaines initialement disjoints de la finance de marché, de la finance d’entreprise et de la théorie de l’équilibre général en économie, pour aboutir à une intégration de ces trois mondes par la notion de noyau d’évaluation par le marché. La martingalisation systématique des marchés – par Bâle III et Solvabilité 2 – s’ensuivra.

Trois histoires de longue durée…

Trois histoires de longue durée, trois aventures intellectuelles de la pensée financière et économique traversent le XXe siècle : elles coexistent séparément dans les travaux universitaires pendant près de soixante ans, en s’ignorant mutuellement jusqu’à leur articulation formelle effectuée dans les années 1980 par une percée conceptuelle majeure, apparue dans la finance mathématique avec la reconstruction des objets de la théorie financière au moyen de la modélisation mathématique de l’arbitrage. Ce qui n’était qu’une pratique empirique devint la brique de base de la construction des instruments financiers : on découvrit à ce moment que, lorsqu’un marché était arbitré, la succession des cours actualisés pouvait être décrite par une représentation mathématique appelée « martingale » (voir Encadré 1). L’équivalence entre arbitrage et martingale, la compréhension de cette dernière comme contrepartie mathématique d’un marché arbitré, fut la première étape de la financiarisation généralisée de l’économie qui caractérise les années 1990 puis 2000.

Ces trois domaines sont respectivement :

- la modélisation des variations boursières par des processus aléatoires, c’est-à-dire une recherche de type descriptive (sans explication causale) pour caractériser par une formule mathématique adéquate la forme des trajectoires de cours observées sur les marchés réels ;

- l’évaluation des actifs financiers et des entreprises, c’est-à-dire la recherche d’une théorie capable de fournir un cadre conceptuel rigoureux permettant de donner un prix supposé juste à tout objet réel pouvant être négocié ;

- la modélisation de l’équilibre en économie, qui inclut les développements de la

théorie économique de l’équilibre général , initialement décrit dans un cadre statique, puis ensuite généralisé dans un cadre dynamique intertemporel.[2]

Des mondes qui s’ignorent…

Ces mondes se sont ignorés, d’autant plus volontiers que les objectifs professionnels étaient différents, voire contradictoires. Par exemple, les évaluateurs de sociétés et les analystes financiers, disposant d’un outillage mathématique rudimentaire, étaient violemment opposés à l’intrusion des processus aléatoires dans les méthodes d’évaluation. Les statisticiens probabilistes qui travaillaient sur les équations de la dynamique boursière ne cherchaient pas à intégrer la notion de valeur des entreprises, ni d’ailleurs celle d’allocation optimale des ressources au sens de la macroéconomie. Quant aux économistes universitaires, ils restaient éloignés des développements de la théorie financière, ceci alors même que ces développements commençaient à mordre sur le champ de l’économie.

On mesure donc le changement important qui fut produit par le désenclavement de ces trois mondes dans les années 1980. Les jonctions des trois domaines de recherche examinés se sont opérées deux à deux au cours de la seconde moitié du XXe siècle. L’unification se produisit en effet par binôme de théories :

- la jonction entre évaluation financière et martingales fut faite par Samuelson entre 1965 et 1973 ;

- la jonction entre martingales et modèles économiques d’équilibre fut faite par LeRoy en 1973 et Lucas en 1978 ;

- la jonction entre la théorie de l’arbitrage et l’évaluation financière fut faite par Ross, Harrison, Kreps et Pliska entre 1976 et 1981.

Trois identifications partielles

Années 1960 : martingale avec taux d'actualisation constant exogène

La première des jonctions intellectuelles, unifiant les méthodes de l’évaluation financière des sociétés et les descriptions probabilistes des variations boursières par des martingales, fut effectuée par Samuelson dans ses articles de 1965 et 1973. Cherchant à réconcilier deux opinions apparemment contradictoires – celles des analystes pour lesquels l’art de l’évaluation financière permet de trouver de bons titres à acheter, et celles des statisticiens pour qui les marchés évoluent apparemment au hasard –, Samuelson fit apparaître que, non seulement ces deux représentations n’étaient pas contradictoires, mais qu'au contraire, plus les investisseurs évalueraient correctement une société en utilisant le modèle de flux actualisés, plus les variations boursières seraient décorrélées.

L’assertion radicale de l’article de 1973 était la suivante : « Les investisseurs qui s’informent (sur les conditions économiques réelles de l’entreprise) ont pour effet, par leurs achats et ventes de titres, de blanchir le spectre des variations boursières. » Un spectre blanc est le signe de variations décorrélées : donc plus les variations de la Bourse ressembleraient à celle de la roue de la roulette d’un casino (le modèle de la marche au hasard), plus cela signifierait que les investisseurs étaient compétents et responsables. Le juste prix bien prévu d’une société était donc celui qui rendait le marché totalement imprévisible. Tel est l’apparent paradoxe de l’idée d’efficacité informationnelle d’un marché, qui ne fut pleinement résolu qu’en 1980 par Grossman et Stiglitz.

Plus précisément, en faisant l’hypothèse que les investisseurs évaluent la société par la méthode des flux actualisés en utilisant un taux d’actualisation (discount rate) quelconque x, et que le rendement (yield) des actions de cette société (rapport dividende/cours) soit y, Samuelson montra que l’on pouvait retrouver une martingale sur le cours de l’action actualisé au taux x – y .

Le taux d’actualisation utilisé par les investisseurs était choisi à partir d’un modèle d’équilibre comme CAPM de Sharpe de 1964 : c’était donc une donnée exogène. De plus, il fallait qu’il soit constant, alors que l’on peut imaginer qu’il fluctue selon les horizons d’investissement considérés. Il fallait également que le rendement de l’action soit stationnaire. Cette première forme de martingale sur les marchés financiers était donc assez restrictive.

Années 1970 : martingale avec taux d’actualisation aléatoire endogène

À partir d’un raisonnement d’équilibre économique, LeRoy (en 1973) puis Lucas (en 1978) généralisèrent cette première martingale de Samuelson en rendant le taux d’actualisation aléatoire et en le plaçant à l’intérieur de l’espérance mathématique (soit un taux « endogène »). L’inverse de ce taux (un facteur d’actualisation aléatoire ou « stochastic discount factor ») est appelé « noyau d’évaluation par le marché » (market pricing kernel). L’équation de Lucas établit la jonction entre l’évaluation financière d’une société et un modèle d’équilibre général en économie avec investisseur représentatif. L’équivalence entre l’équation de Lucas et le modèle d’équilibre général d’Arrow et Debreu fut obtenue en développant l’espérance mathématique sur les différents états du monde : la valeur du noyau de l’évaluation dans un état du monde est égale au prix du titre élémentaire quantifiant cet état, ajusté par la probabilité de l’état correspondant. D’où l’écriture du noyau en actifs d’Arrow et Debreu.

Années 1980 : martingale avec taux sans risque et probabilité modifiée

La percée intellectuelle de la finance mathématique, qui sera à l’origine de l’universalisation de l’idée d’évaluation au juste prix par un taux sans risque comme les taux des coupons zéro arbitrés, va être opérée à la charnière des années 1980, dans la réinterprétation du noyau et des prix d’Arrow et Debreu au moyen des opérateurs du calcul stochastique.

L’intuition fondamentale qu’ont eue, entre 1976 et 1981, Ross, puis Harrison, Kreps et Pliska, a consisté à réinterpréter les prix des états du monde d’Arrow et Debreu comme des valeurs d’une probabilité particulière lorsque le marché était arbitré. Le passage de la probabilité réelle (que l’on note P) à la probabilité modifiée (que l’on note en général Q) s’effectua au moyen de la technologie du calcul intégrodifférentiel stochastique, par l’opérateur de Radon-Nikodyn (ou opérateur de changement de probabilité) noté L et défini en temps discret par « L = Q/P ». D’un point de vue intuitif, le monde dual de la probabilité notée Q peut être compris comme un univers psychologique dans lequel les individus seraient indifférents à la chance de gain comme au risque de perte : cette neutralité psychologique vis-à-vis du risque explique à la fois la terminologie de langue anglaise (risk neutral probability) et l’actualisation à un taux d’intérêt qui, de ce fait, n’inclut pas de prime de risque. C’est sur cette base conceptuelle que se sont construites les normes financières de l’évaluation des bilans en « fair value ».

Les fondements de l’évaluation moderne des actifs financiers

Par la transformation de l’ensemble des équations d’évaluation écrites précédemment dans le monde réel en nouvelles équations écrites dans le monde dual de Q, Harrison, Kreps et Pliska ont posé les fondements de l’évaluation moderne des actifs financiers : le juste prix de tout actif financier n’est rien d’autre que l’espérance mathématique de sa valeur future calculée avec la probabilité Q, et actualisée à un taux sans risque : typiquement le taux des emprunts d’État, pour autant que les dettes souveraines soient classées dans la catégorie « sans risque ».

Du point de vue de la dynamique boursière, toutes les martingales écrites avec la probabilité P et un taux d’actualisation incluant une prime de risque, se transforment en martingales avec la probabilité Q et un taux d’actualisation sans risque : on passe de P-martingales à une Q-martingale au moyen de l’opérateur L, et la possibilité même de ce passage est la trace mathématique de l’existence d’un marché arbitré à l’équilibre, c’est-à-dire dans lequel il n’y a plus aucun arbitrage à effectuer (absence of opportunity of arbitrage). La nouvelle relation sur les prix actualisés au taux sans risque devient une martingale avec cette probabilité Q.

La synthèse par le noyau d’évaluation

L’identification financière concrète du noyau d’évaluation sera le fait de Long en 1990 : le noyau sera interprété sur un marché réel comme le facteur d’actualisation au taux de rentabilité d’un portefeuille qui maximiserait pour tout investisseur la croissance de son patrimoine (encore appelé portefeuille Log-optimal). Avec le portefeuille Log-optimal, on retrouve à nouveau une martingale, mais avec comme taux d’actualisation utilisé, le taux de rentabilité du portefeuille Log-optimal.

Fondamentalement, la représentation d’un équilibre de marché par le noyau d’évaluation conduit donc nécessairement à une modélisation de la dynamique boursière par une martingale, ce qui correspond indifféremment à une évaluation juste d’une société (au sens de la valeur de Fisher-Williams) ou à une optimalité au sens de l’allocation des ressources et des risques (au sens de Walras-Pareto). Aussi, la notion de noyau d’évaluation, qui représente l’aboutissement des développements de la théorie de l’équilibre général passés dans la finance professionnelle, peut être comprise comme l’objet intellectuel qui a permis à la pensée financière de s’unifier dans les années 1980, pour parvenir à une compréhension globalisante de la totalité des phénomènes économicofinanciers existants. Le développement des marchés de capitaux et la financiarisation du monde réel s’en sont suivis. Aujourd’hui, rien ne semble pouvoir résister à l’apparente universalité du concept de noyau d’évaluation (voir Encadré 3).

Une action collective normative à grande échelle

La synthèse intellectuelle des années 1980 a représenté un moment très particulier dans l’histoire de la finance au XXe siècle, résultant d’une conjonction exceptionnelle de talents déployés à la fois dans les domaines de la finance mathématique, dans les pratiques professionnelles américaines des banques de marché, ainsi que dans les développements de la théorie des probabilités sur les processus aléatoires. La forme mathématique que prit cette jonction conceptuelle fut l’équation d’évaluation en noyau, qui exprima à la fois l’équilibre d’un marché, son optimalité au sens de Pareto, l’évaluation juste de tous les actifs cotés et la propriété de martingale de la dynamique boursière associée.

La compréhension profonde de l’équivalence entre arbitrage et forme martingale, cette dernière représentant la contrepartie mathématique d’un marché arbitré, fut l’étape intellectuelle indispensable, le tournant de la pensée financière qui libéra l’imagination des ingénieurs financiers et des régulateurs. Dès lors, la martingalisation systématique des marchés – dans le sens de sa mise en ordre par des martingales, la courbe des taux sans risque – représentera l’équivalent pour la finance du XXe siècle de la moyennisation systématique des variables dans la statistique du XIXe siècle : une action collective normative pour les pratiques professionnelles à grande échelle.