Les assureurs dommages sont aujourd’hui confrontés à l’impact de plus en plus significatif des risques majeurs (climatiques et technologiques) sur leurs résultats. Face à la recrudescence de ces risques et à leurs perspectives défavorables, les compagnies d’assurance doivent revoir de façon radicale la maîtrise de leur exposition à ces risques et, plus généralement, la gestion de leurs risques. D’autant que le cadre juridique et prudentiel les y contraint (directive Solvabilité 2, évolution du régime

I. La dimension spatiale d’un portefeuille de risques non-vie

L’assurance se résume souvent à la maîtrise des sciences juridiques et statistiques. Toutefois, l’assurance dommages présente la particularité d’être également impactée par la géographie. Pour s’en convaincre, il suffit d’observer la dimension spatiale de ce qui fait la matière première en IARD : l’exposition d’un portefeuille de risques sur un territoire donné et la dimension spatiale des aléas qui caractérisent l’ensemble des périls étudiés (voir Encadré 1).

Les risques majeurs sont un enjeu pour quatre principales raisons :

- l’augmentation de la matière assurable, donc de la probabilité de survenance de sinistres technologiques et des coûts d’indemnisation ;

- l’augmentation de la fréquence de survenance d’événements climatiques ;

- l’évolution du régime Catnat et ses implications pour une société d’assurance ;

- la directive Solvabilité 2 et le besoin d’optimiser les fonds propres d’une entreprise d’assurance et d’améliorer la gestion qualitative des risques.

Deux défis se présentent aux assureurs :

- être en mesure de mieux connaître leur exposition, afin de déterminer leur niveau d’engagement et leurs besoins en fonds propres. Ce besoin fait appel au développement de modèles ;

- être capable d’améliorer transversalement la gestion de leurs risques, de la tarification à la gestion des sinistres en passant par la souscription, avec la mise en place d’une démarche d’Entreprise Risk Management (ERM).

Dans ce contexte, comment intégrer la dimension spatiale d’un portefeuille de risques si la géographie (voir Encadré 2) et les facteurs externes au portefeuille ont un rôle impactant dans la sinistralité face aux risques majeurs ?

II. La nécessité d’une gestion transversale des risques majeurs

Les modèles de marché d'évaluation des sinistres sont fréquemment utilisés pour définir les besoins en réassurance par rapport aux risques. Mais comment décider de l'achat d'une couverture de réassurance si un modèle indique un besoin en couverture de 50 millions d’euros pour faire face à un sinistre tempête dont la récurrence est de 200 ans, alors qu'un autre modèle évalue le même risque à 100 millions d’euros ? De telles divergences entre les différents modèles les plus courants ne sont pas rares. Ce n'est pas seulement le cas en France, mais également sur tous les autres marchés européens concernés. Les souscripteurs de réassurance ont dû apprendre à se contenter des modèles de marché disponibles, mais la situation reste très insatisfaisante.

Modélisation interne et Entreprise Risk Management

La modélisation interne et l’ERM est une révolution des esprits autant que des structures. Aucune entreprise d’assurances ne pourra demain faire l’économie d’une organisation performante du contrôle de son exposition aux risques. À terme, cela signifie que des modèles internes seront nécessaires, pour définir et démontrer le contrôle de cette exposition, au-delà des obligations créées par la formule standard (Solvency Capital Requirement). Elle offre pourtant des perspectives considérables d’amélioration de la qualité du management, bien au-delà des sécurités sur la solvabilité.

L’exposition aux risques majeurs de l’assureur ne s’arrête évidemment pas à la couverture des risques qu’il accepte, mais bien à l’ensemble de son activité, y compris les conditions de cette acceptation. Le COSO a produit une nomenclature des risques (stratégique, opérationnel, de reporting et de « conformité») à laquelle chacun se conforme. L’ERM est le fondement de l’action du management d’entreprise, notamment parce qu’il engage la responsabilité des membres du Conseil d’administration, influe sur la notation des agences et fonde le contrôle des autorités françaises (ACP) et européennes.

Définir « l’appétit pour le risque » de l’entreprise est l’acte fondateur de l’ERM. Cet appétit se définit, dans la logique de Solvabilité 2, en termes d’exposition des fonds propres de l’entreprise. Cela revient à définir la part des fonds propres perdus ou la perte d’exploitation maximale tolérable, dans le cas d’une année marquée par de nombreux sinistres, compte tenu des protections tirées de la réassurance. Cela revient aussi, et ce sera sans doute la conséquence majeure de Solvabilité 2, à définir le portefeuille de souscription de manière optimale par rapport au niveau des fonds propres et à la marge de solvabilité disponible, sous une contrainte de résultat d’exploitation attendu, ou de rémunération du capital (ROE) demandé par les marchés et les investisseurs.

Toutefois, un modèle interne doit pouvoir s’apprécier au regard de l’ensemble de l’expertise présente chez un assureur, des services techniques qui conçoivent et suivent les résultats techniques de chaque produit au réseau commercial qui souscrit les risques, en passant par les experts sinistres qui évaluent et gèrent les sinistres jusqu’au service en charge de la réassurance.

Développer des outils ad hoc

Après avoir posé le constat couramment partagé du manque d’outils robustes en France pour l’évaluation des risques majeurs dans l’assurance dommages, la démarche est ici de proposer des solutions techniques permettant le développement d’outils répondant spécifiquement aux besoins des assureurs dommages en France, tant sur la maîtrise d’exposition de portefeuille que sur la mise en place d’un ERM pour améliorer la gestion des risques au niveau de l’ensemble de métier d’une compagnie.

Les assureurs, encadrés par les piliers 1 et 2 de la directive Solvabilité 2, vont devoir s’approprier les méthodes d’analyse et mettre en place des outils pour gérer leurs expositions aux risques majeurs.

Les souscripteurs et les actuaires impliqués dans la souscription et le transfert des risques en réassurance ont longtemps tarifé les risques sur la base de modèles statistiques, c’est-à-dire fondés sur la sinistralité historique de leurs données internes. Or ces modèles, bien qu’extrêmement utiles en tant que modèles de référence, n’offrent pas la fiabilité voulue pour permettre une évaluation précise du risque de catastrophe, la raison principale étant le manque de données statistiques concernant les événements historiques.

La vulnérabilité a été présentée comme la confrontation des données sur les enjeux avec des données sur les aléas. Il a été montré que l’exposition d’un portefeuille résulte de la spatialité de l’aléa qui introduit une dimension géographique et exogène au risque assuré. D’autres facteurs viennent encore compliquer l’indexation des sinistres historiques, comme les normes de construction, les changements dans les pratiques d’assurance (applications de franchises, pratiques dérogatoires, etc.), la densité démographique et la concentration des valeurs. Le champ d’application du modèle statistique ne dépasse généralement pas la palette d’événements représentée dans l’échantillon statistique ; une approche spatiale, géographique en associant les factures exogènes à un portefeuille de risques est donc nécessaire.

III. Les enjeux de l’intégration des données comme variable d’analyse d’une exposition aux risques

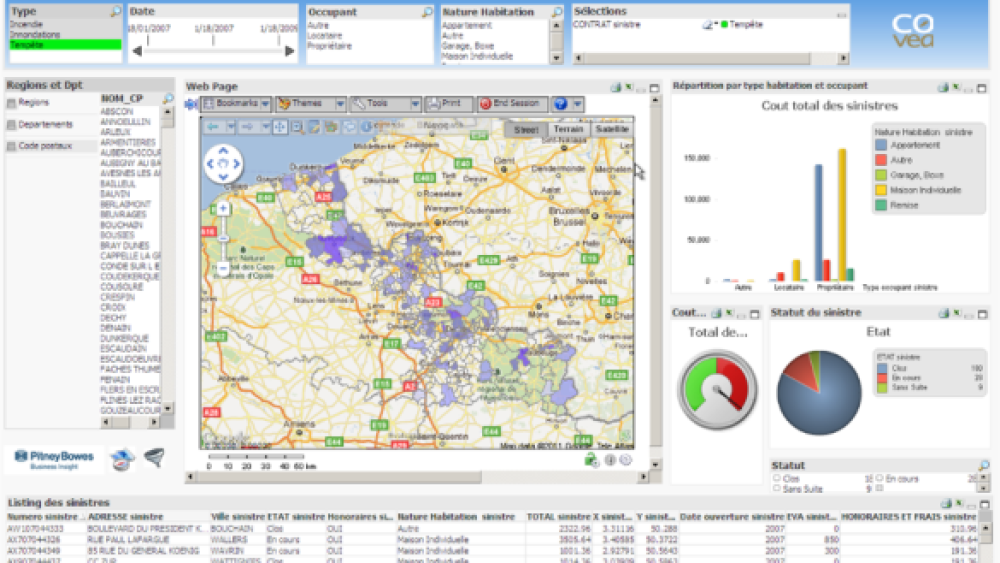

Ces constatations qui peuvent être faites à partir des données de marché peuvent trouver une première réponse dans l’analyse spatiale de données. Des outils et des modèles peuvent s’appuyer sur des technologies comme les SIG (systèmes d’information géographique).

L’exploration de ces indicateurs sous-tend la manipulation d’un volume important d’informations géographiques et non géographiques. Une vision complète des phénomènes nécessite de pouvoir étudier les valeurs des indicateurs à des échelles détaillées comme à des échelles agrégées au travers de vues de synthèse (voir Encadré 3) ; le passage d’une échelle géographique détaillée comme une parcelle cadastrale à une échelle nationale implique une capacité à gérer de gros volumes de données. Les modes de stockage et d’interrogation des indicateurs doivent permettre de restituer à l’utilisateur les résultats de la façon la plus pragmatique possible.

Du fait du caractère spatialisé des risques naturels et technologiques, tout outil d’analyse ne peut s’affranchir de la composante géographique des biens exposés (enjeux) et des dangers naturels (aléas). Les risques naturels sont ceux ayant la plus forte dépendance géographique, comme en témoignent les nombreux ouvrages dédiés à la gestion spatiale des risques naturels et les outils exploitant l’information géographique (voir Encadré 4).

La gestion des risques climatiques et technologiques nécessite d’analyser un certain nombre d’indicateurs sur la vulnérabilité des enjeux (les biens, les personnes, les activités) susceptibles d’être affectés par la survenance d’un ou de plusieurs aléas. Les indicateurs sont consolidés à partir de la confrontation de données ayant des contenus homogènes, associant des composantes géographiques et non géographiques, provenant de plusieurs sources différentes.

La prise en compte de la composante géographique

Le croisement des données sur les aléas et sur les enjeux permet d’obtenir un premier diagnostic sur la vulnérabilité et d’en déduire les pertes financières. La composante géographique est essentielle à prendre en compte pour pouvoir réaliser ces croisements. Que ce soit pour la caractérisation des aléas comme des enjeux, il existe une représentation géographique associée : un aléa est caractérisé par une emprise géographique et une intensité variable d’une zone à une autre du bassin de risque étudié ; les enjeux sont caractérisés par une localisation et une distribution spatiale sur le territoire.

Les outils et modèles s’appuyant sur des systèmes d’information géographiques utilisent les sciences naturelles pour mieux circonscrire les événements possibles. En outre, ils analysent les portefeuilles en termes de vulnérabilité des bâtiments et de distribution géographique, ils peuvent intégrer des caractéristiques secondaires (âge du bâti, données socio-économiques) et sont capables de modéliser directement les caractéristiques du risque et des caractéristiques du contrat d’assurance auquel il est rattaché.

Les décideurs ont besoin d’une vision globale et intégrée de la gestion des risques. Les solutions de marché constituent indéniablement un progrès pour l’ensemble du secteur et les SIG constituent une première réponse pour mieux intégrer le risque assuré dans son environnement.

Les systèmes d’information géographique

Les SIG disponibles sur le marché français s’orientent vers la souscription des risques au regard des risques naturels, d’autres vers la modélisation de catastrophes via la simulation d’événements majeurs. Toutefois, il n’existe pas d’outils polyvalents et transversaux qui répondent à l’ensemble des métiers d’une chaîne de production. Les fonctionnalités attendues résident dans la capacité à intégrer des données géographiques et non géographiques, à croiser des données ayant des contenus hétérogènes et à disposer de fonctionnalités d’exploration des indicateurs pour étudier les corrélations.

Les SIG offrent la possibilité pour un assureur de développer lui-même ses propres solutions et de pouvoir ainsi apporter des réponses sur-mesure aux besoins spécifiques des entités métiers.

Le développement d’outils et de modèles internes constitue un apprentissage pour la société d’assurances, une connaissance des données à exploiter et du recul sur l’interprétation des résultats, qui augmente sa connaissance de son exposition.

IV. Vers une technologie émergente : le géodécisionnel

La piste technologique pressentie réside dans les solutions géodécisionnelles.

Les SID (systèmes d’information décisionnels) utilisés au sein des systèmes d’information d’entreprise permettent aux décideurs d’accéder à des fonctionnalités d’analyse et de reporting à partir de données collectées dans les diverses sources de données distribuées dans le système d’information de l’entreprise. Les SID sont entendus comme l’ensemble des moyens, des outils et des méthodes qui permettent de collecter, consolider, modéliser et restituer les données d’une entreprise en vue d’offrir une aide à la décision et de permettre aux responsables de la stratégie d’une entreprise de voir de façon synthétique l’ensemble de l’activité traitée. Ils reposent sur une méthode de modélisation de données dite multidimensionnelle permettant de construire des structures de données orientées par thème afin de pouvoir explorer et analyser les données pour la prise de décision.

Afin de répondre à des problématiques d’entreprise ayant une composante géographique, certains systèmes décisionnels tentent de se doter d’extensions géographiques en intégrant des fonctionnalités propres aux sciences de la géomatique. Celle-ci est entendue comme l’ensemble des méthodes et outils permettant de représenter, d’analyser et d’intégrer des données géographiques autour de trois activités que sont la collecte, le traitement et la diffusion.

Le terme de SIG intelligent est utilisé comme synonyme du terme « géodécisionnel », utilisé pour qualifier un type de système d’information associant les fonctionnalités des SID et celles des SIG.

Le géodécisionnel se définit comme une discipline technologique regroupant l’ensemble des moyens, outils et méthodes permettant de collecter, consolider, modéliser et restituer des données en vue d’offrir des capacités d’analyse globales et détaillées dans l’espace et dans le temps. Ces systèmes reposent sur une méthode de modélisation dite spatiale multidimensionnelle (voir Encadrés 5 et 6).

V. Conclusion

À la base de l’ERM se trouvent la gestion des risques et leur contrôle. L’émergence du risk management dans le monde de l’assurance est très récente au regard de son existence dans d’autres secteurs. En effet, la démarche d'analyse et d'identification systématique des risques est assez traditionnelle dans les secteurs industriels où la gestion des risques est devenue indissociable de la démarche qualité. En revanche, l'analyse de risque est beaucoup plus récente dans le domaine de la gestion et de l'économie, qui en était relativement écarté du fait de l'absence (apparente) de risques directs sur la vie humaine.

Concernant l’état de l’art du contrôle interne et du risk management dans le secteur de l’assurance et de la protection sociale, nous pouvons mettre en évidence les différentes motivations :

- Solvabilité 2 est, chez les assureurs, la contrainte réglementaire actuellement la plus forte qui motive la mise en place de cette fonction ;

- une volonté du top management de l’entreprise, suite à une prise de conscience qu’il est nécessaire de mettre en place une gouvernance d’entreprise forte ;

- à la suite d’événements déclencheurs, la survenance d’un ou plusieurs sinistres majeurs dans l’entreprise ou dans le secteur.

Cette démarche, en rapprochant deux univers d’analyses séparés au sein de l’entreprise d’assurance, vise à apporter des réponses aux problématiques transversales de l’ensemble des métiers d’une société d’assurance exposée aux risques majeurs. Cette technologie doit offrir la possibilité d’exploiter l’analyse spatiale de façon plus intégrée au système décisionnel de l’entreprise d’assurances.

Le géodécisionnel constitue une technologie émergente qui n’a pas encore fait l’objet d’une véritable appropriation par le monde économique des entreprises, tout spécialement le secteur de l’assurance dommages. Cette technologie tend à apporter une réponse opérationnelle à la gestion qualitative des risques, par une analyse spatiale et multidimensionnelle de portefeuilles de risques, rendant possible la mise en place d’un ERM au sein d’une compagnie d’assurance non-vie.

Plus que jamais, les systèmes d’information seront impliqués dans l’évaluation, la tarification, la réassurance des risques. L’ERM et Solvabilité 2 imposeront aux entreprises, même non cotées, des obligations de transparence et de reporting qui nécessiteront des systèmes d’information plus centralisés et plus sophistiqués.