La mise en place de systèmes de pilotage par la valeur dans les institutions financières peut sembler une démarche simple et séduisante :

– première étape : éclatez le besoin de capital à risque par segments d’activité ;

– deuxième étape : calculez les taux de rentabilité (résultat/capital à risque) par segment ;

– troisième étape : fixez-vous un taux de rentabilité plancher et évaluez à partir des plans d’affaire les segments créant (rentabilité supérieure au plancher) ou détruisant (rentabilité inférieure au plancher) de la valeur ;

– quatrième étape : analysez les écarts les plus significatifs en valeur et mettez en place les plans d’actions pour améliorer la performance de votre entreprise.

Une démarche complexe

Cette vision simple ne doit pas faire oublier que la mise en place d’un système de pilotage par la valeur est une démarche éminemment complexe. Elle fait intervenir de multiples acteurs aux objectifs parfois divergents. Chaque étape nécessite des choix de traitement techniques qui perdent souvent de vue la finalité très opérationnelle de ces cadres et s’enlisent dans des débats actuariels, financiers ou comptables sans fin.

Car la finalité de tels cadres est bien l’adoption de nouvelles métriques intégrant le besoin de capital dans la pratique des responsables opérationnels, c’est-à-dire de structurer rapidement un dialogue avec la direction générale ou le conseil d’administration sur l’adoption de plans d’actions, après analyse des écarts significatifs aux cibles, pour revenir dans la trajectoire rendement-risque souhaitée.

Cette phase d’appropriation, qui peut être facilitée par certains choix techniques, est probablement la plus sous-estimée et pourtant celle qui déterminera le succès (« ces indicateurs me permettent de me concentrer rapidement sur ce qui est important ») ou l’échec (« ces indicateurs s’ajoutent aux métriques existantes et ne me servent pas ») de tels projets de transformation.

Des résultats décevants

Alors que banques et compagnies d’assurance ont déployé ces dernières années une énergie considérable pour identifier et quantifier le risque de leurs activités, pour résumer les calculs de pilier 1, c’est dans le domaine de l’intégration opérationnelle de ce besoin de capital dans la prise de décision que le plus long chemin reste à faire. C’est un paradoxe car c’est une demande récurrente des autorités de tutelle et de contrôle, et un élément important dans la validation (test d’utilisation) des modèles internes.

C’était le constat fait en 2015 par Oliver Wyman dans son rapport « Managing complexity » qui soulignait qu’en dépit de 20 ans de progrès sur les mesures de performance ajustées au risque (RAROC capital ajusté au risque ou EVA valeur ajoutée économique), peu d’institutions financières disposaient d’un cadre satisfaisant permettant de comparer et d’analyser la performance de leurs activités

Des techniques anciennes tombées en désuétudes

Ces techniques ne sont pourtant pas nouvelles et ces cadres apparus dans le domaine bancaire aux États-Unis dans les années 1970-1980 (Bankers Trust, JP Morgan, Bank of America) se sont perfectionnées au fil des ans, et généralisés aux plus grandes banques et groupes d’assurance européens au cours des années 2000.

On constate que la mise en place de systèmes de pilotage fondés sur la valeur ajoutée économique a reflué avec le temps. Ainsi, dès son rapport annuel 1998, Allianz évoque la valeur ajoutée économique (Economic Value Added ou EVA®), définie comme la différence entre la rentabilité et le coût des capitaux à risque, comme l’information la plus importante pour la prise de décision dans l’entreprise. Pendant plus de 10 ans, ce concept de création de valeur pour l’actionnaire a été cité par le rapport annuel d’Allianz qui soulignait notamment l’alignement des intérêts des actionnaires et des hauts dirigeant par des systèmes d’intéressement basés sur la valeur économique. En 2010, le terme EVA® disparaît des rapports annuels pour être remplacé par le concept de « gouvernement d’entreprise fondé sur la valeur » et plus récemment par le concept de création de valeur pour le client.

Jugés trop complexes, nécessitant de multiples retraitements comptables, trop financiers et pas assez axés sur la réalité opérationnelle de l’activité, ces cadres holistiques et cohérents ont été souvent abandonnés pour des indicateurs partiels de nature multiples qui creusent plutôt que réduisent le fossé entre les responsables opérationnels jugés sur des indicateurs très concrets (statistiques type nombre et moyennes, ratios sur activité ou encours…) et les hauts dirigeants dont une partie de la rémunération est lié directement à des indicateurs financiers ou de marché

Modèle de pilotage de la valeur : coût du capital de la firme ou par segment ?

Dans la typologie des modèles de pilotage par la valeur, un critère de distinction majeure semble être l’utilisation d’un taux de rentabilité plancher unique ou le recours à des taux de rentabilité différenciés par segments.

Les modèles de pilotage par la valeur à taux d’actualisation unique sont les plus courants. Quatre banques sur cinq dans une étude de 2011 de McKinsey utilisent un taux d’actualisation unique évalué à partir du modèle d’équilibre des actifs financiers (MEDAF) où le taux de rentabilité requis est la somme du taux sans risque plus la prime de risque du marché multiplié par le risque spécifique ou béta de l’entreprise

Un apport analytique puissant en période de crise

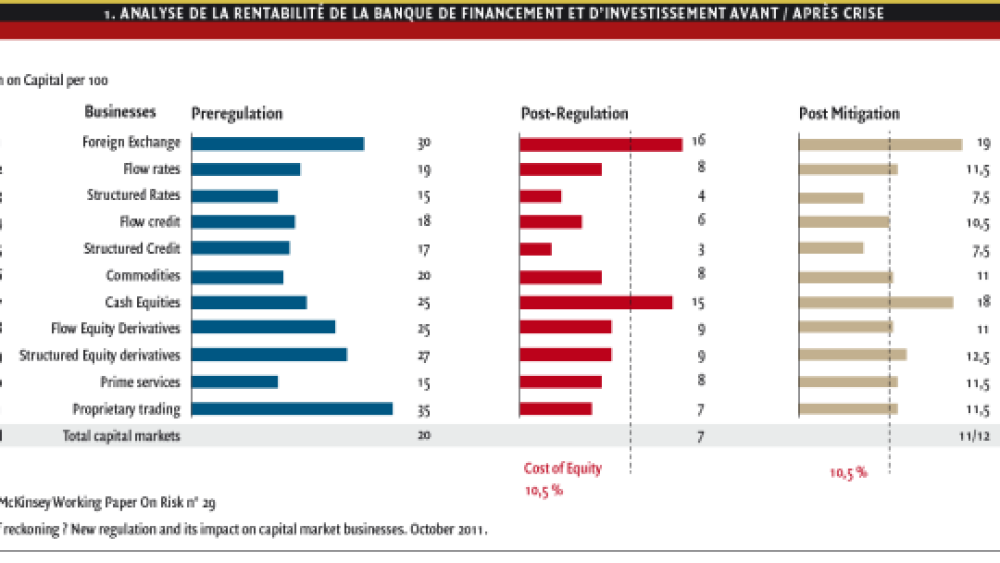

Une bonne illustration de l’apport analytique de la démarche est donnée par l’analyse de la banque de financement et d’investissement après la crise de 2008 faite en 2011 par McKinsey, qui est présentée dans le tableau 1. Sur un panel de 13 banques, la rentabilité annuelle avant crise s’établit à 20 % tous segments réunis. Après renforcements réglementaires, la rentabilité « toutes choses égales par ailleurs » chute à 7 %.

Différentes mesures opérationnelles menées par les banques permettraient de faire remonter la rentabilité globale à 11-12 %. Néanmoins si on prend un coût du capital de 10.5 % certaines activités resteraient critiques (produits de taux et financement structurés) et ne financeraient pas avec une rentabilité de 7-8 % le coût du capital.

C’est une approche identique qui a été menée en 2012 par Aviva dans le cadre de son plan stratégique après le départ de son directeur général Andrew Moss. Avec l’aide du Boston Consulting Group

Ces deux exemples illustrent l’application de ces techniques (comparer la rentabilité des activités à un coût du capital pour identifier les activités nécessitant d’être redressées ou cédées ; utiliser en complément à la création de valeur des matrices multicritères intégrant notamment la génération de cash-flow à l’actionnaire) dans un contexte de crise, avec des mesures chirurgicales associées. Ainsi Aviva réduisit le nombre de ses cadres supérieurs de 25 % en un an après la mise en place de son plan de redressement !

Quel usage de ces cadres dans la gestion courante de l’entreprise ?

L’idée est d’introduire dans la gestion courante, de manière préventive, ce type de cadre analytique afin de lutter contre l’opacité et l’inertie, lisser les ajustements dans le temps et éviter ces périodes de crise révélant de manière brutale des déséquilibres latents.

Le paramètre taux de rentabilité plancher est critique mais l’usage d’un taux unique (le coût du capital de la firme) est critiqué par la communauté académique pour apprécier la rentabilité par segments.

Les manuels de finance recommandent l’usage de taux différenciés reflétant le risque de chaque segment. En février 2011 une étude de Philipp Kruger, Augustin Landier et David Thesmar (« The WACC Fallacy : The Real Effects of Using a Unique Discount Rate ») démontrait que les entreprises utilisant un taux unique dans le cadre du choix des investissements, allaient surinvestir dans les projets avec la volatilité la plus importante.

En termes de pilotage, un taux unique ne donne pas une information pertinente. Chaque entreprise gère des portefeuilles d’activités diversifiées avec des niveaux de marge par métier différents correspondant à leur maturité, les situations de marché, ou leur rôle dans la gestion de l’entreprise.

On peut être amené à fournir des services moins rentables mais requis par le client ; ou avoir des activités considérées stratégiques mais actuellement déficitaires ; tout comme des activités très profitables mais déclinantes.

Si le coût du capital est de 10 % et que la rentabilité cible de tel segment est de 5 %, l’information d’une « destruction de valeur » qui sera probablement reflétée dans les budgets et plans d’affaires n’est pas une information pertinente en termes de pilotage. Ce qui a de l’intérêt est de mesurer en valeur l’écart positif (rentabilité prévue de 7 %) ou négatif (rentabilité prévue de 3 %) à la cible pour évaluer les écarts, voir les dynamiques d’écart sous-jacentes (maintien, accroissement, réduction) et hiérarchiser les écarts en valeur entre segments pour structurer le dialogue avec la direction.

Toutefois, le premier constat est qu’une démarche d’éclatement de la volatilité (ou du risque) de l’entreprise par segment est une démarche technique complexe et hasardeuse. Un des pionniers la Bank of America s’y était essayé dans les années 1990 pour y renoncer

Pour une évaluation simple de la rentabilité par segment

Plutôt qu’une détermination « en chambre » par les financiers de taux d’actualisation, la solution idéale ne serait-elle pas de faire évaluer des taux de rentabilité plancher par segment par les opérationnels dont l’agrégation permet de satisfaire la contrainte coût de capital ?

La démarche d’évaluation de taux de rentabilité cible différenciés par segment peut être simple pour disposer d’indicateurs de pilotage (écarts à la cible) sans chercher à entrer dans le débat des volatilités par segment.

Soulignons d’ailleurs que le capital à risque de pilier 1 pour une activité n’est souvent que la traduction très partielle de la volatilité des performances liée également et surtout à une volatilité résultant de problématiques commerciales et concurrentielles de marché. Et que cette volatilité reste difficile, sinon impossible, à recaler avec la volatilité de marché telle qu’intégrée dans le MEDAF.

On traduit d’abord les indicateurs financiers en valeur cible à 3 ou 5 ans : par exemple une rentabilité de 10 % sur 100 millions d’euros de capital à risque progressant de +5 % par an donne un résultat attendu de 16,5 millions d’euros en troisième année

Par exemple un métier d’assurance A se donnant une cible de résultat de 3 % des primes (résultat qui aura été analysé dans ses composantes constitutives cibles : primes, sinistres, frais acquisition, revenus financiers) et avec un besoin de capital de 20 % des primes évalué par les services actuariels, aura un taux d’actualisation cible de 3 %/20%= 15% ou taux de croissance cible du capital requis.

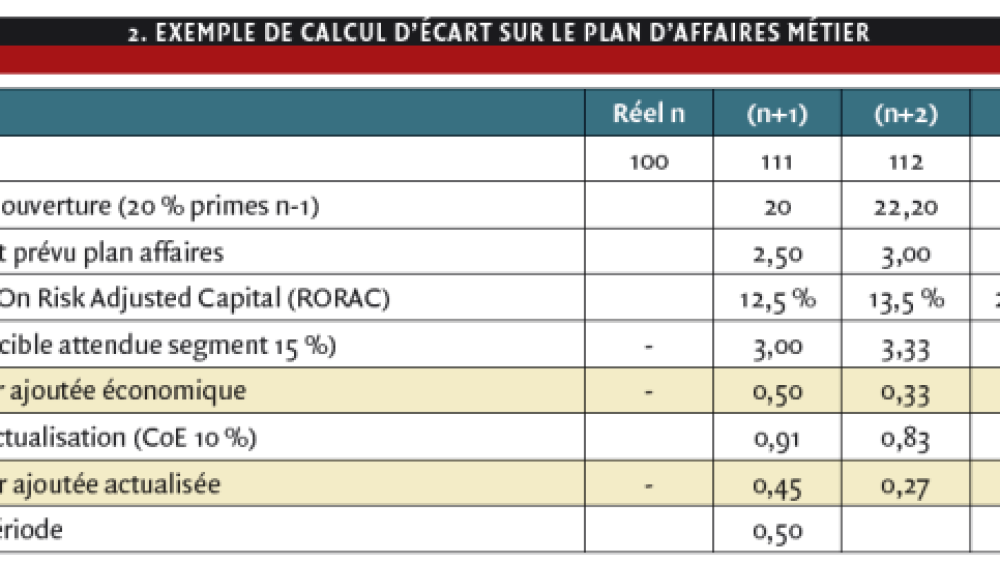

Dotés de taux cibles par segments les plans d’affaires pourront être criblés avec ces cibles pour déterminer et analyser les écarts. Le tableau 2 illustre le calcul pour un segment a dont le taux de croissance cible du capital économique a été fixé à 15 % par an.

La démarche dispose donc de taux de croissance cible par segments différenciés permettant de mesurer les écarts. Si on souhaite avoir une vision pluri annuelle cumulée pour le segment ou pour l’entreprise tous segments réunis, il suffit d’actualiser les écarts avec le taux de rentabilité de l’entreprise (Cost of Equity) de 10 % qui assurera la parfaite comparabilité et additivité des écarts en valeurs par segments au niveau de la firme.

Nous n’avons pas d’approche de la volatilité par segment, mais rien n’empêche de chiffrer en complément avec les responsables d’activité des scénarios probabilisés (affecter une probabilité au scénario central et l’encadrer par des scénarios haut-bas probabilisés) qui permettront de calculer écarts types et espérances et de calculer des résultats à risques (earning at risk).

Conclusion

Les techniques de pilotage par la valeur, même si le cadre conceptuel est ancien, ont beaucoup évolué au cours des dernières années.

Quatre axes nouveaux et majeurs nous paraissent devoir être dégagés :

1. L’optimisation ne signifie plus résultat maximum par unité de risque, mais un risque minimum pour un résultat cible normé à moyen terme jugé possible et souhaitable (fair return). Nous sommes sur un autre point de la frontière efficiente que celui d’avant crise : celui qui privilégie le résultat opérationnel et sa prédictibilité au levier utilisé pour maximiser la rentabilité ;

2. Les résultats cibles doivent être évalués avec ceux chargés de les atteindre et non leur être imposés de l’extérieur. Un article de mars 2018 de la Harvard Business Review titrait « Les gens ne veulent pas être comparés aux autres dans les évaluations de performances. Ils veulent être comparés à eux-mêmes » ;

3. L’objectif moyen terme joue le rôle d’une bouée dans une régate. Pour l’atteindre, les responsables opérationnels qui sont vent debout vont « tirer des bords ». C’est cette mesure et analyse des écarts par rapport à une trajectoire rectiligne (un taux de croissance annuel moyen pondéré) qui va être au cœur du dispositif de pilotage ;

4. Le capital qui est devenu une ressource rare n’est ni « consommé » ni la « propriété » des responsables d’unité. L’objectif n’est pas de transformer les responsables d’unités en actionnaires : ils sont les gardiens et non les propriétaires du capital.

Ce message responsabilisant est universel, que la société soit cotée ou non, avec des actionnaires ou des sociétaires : détruire le capital n’est pas a priori une option pour les responsables d’entités qui doivent déployer leurs talents pour rendre le capital confié dans un meilleur état que celui où il leur a été confié.