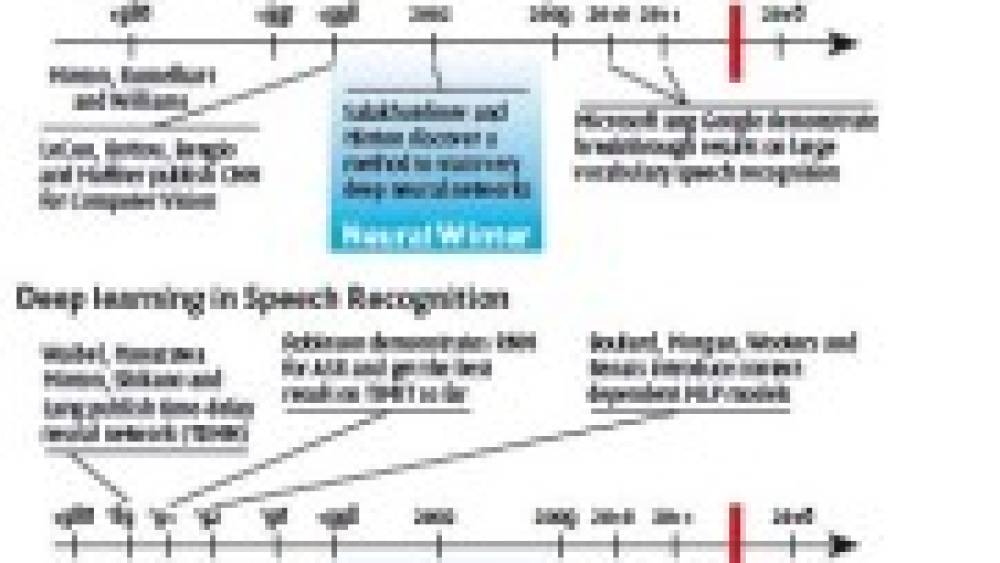

Si les approches neuronales remontent aux années 1950 et furent assez populaires au début des années 1990, elles connurent, avant de connaître le regain d’attention actuel, un « long hiver ». On peut rapprocher ce phénomène du fameux « long hiver de l’intelligence artificielle », même si les deux disciplines n’avaient pas encore convergé.

Nous empruntons les schémas ci-dessous, avec son autorisation, à Nikko Ström, Senior Principal Scientist chez Amazon, pour illustrer ce long hiver, pendant lequel les quelques téméraires qui se risquaient à travailler sur le sujet voyaient leurs articles refusés dans les grandes conférences académiques.

Pour expliquer ce réveil soudain, le consensus est qu’il correspond à la conjonction de trois phénomènes :

- des corpus de données d’apprentissage 10 fois à 100 fois plus volumineux que dans les années 1990 ;

- des capacités de calcul parallèle multipliées d’un facteur proche de 100 grâce à l’usage des GPU – les graphical processing units – des cartes graphiques initialement dédiées aux calculs de rendu graphique 3D pour les jeux vidéo, et détournées de leur usage au service des calculs massivement parallèles de l’apprentissage profond ;

- des progrès dans les algorithmes d’apprentissage pour les réseaux de neurones dotés d’un grand nombre de couches cachées.