Les données massives dans l’assurance, c’est la promesse de parts de marché sans limite pour les premiers arrivés… et le bouillon pour les autres. En effet, leur traitement devrait permettre de segmenter plus finement que jamais ; aussi la guerre des tarifs et la sélection seront-elles sans pitié, pour le plus grand profit du consommateur. Le tout naturellement, sous l’œil ému des représentants de l’intérêt général, qui célébreront les progrès de la science actuarielle au service du bien-être des peuples. Cette image d’Épinal a le mérite de faire vendre dans l’allégresse des « solutions » diverses, comme autant d’amulettes présumées attirer la bienveillance des divinités statistiques. Voilà une présomption qui mérite un examen critique. Dans la suite de cet article, nous proposons de rappeler que :

- la fin de la segmentation s’appelle « échec de marché » ;

- plus on a de données, plus on a de chances de se tromper ;

- une manière simple de démasquer les charlatans consiste à demander quelle proportion des données a été « créée » au cours des deux dernières années.

Le mythe de la segmentation sans limite

Si on conçoit la segmentation comme le « processus vertueux conçu pour minimiser la taille des classes de risque », suivant l’élégante définition de Porrini (2015), alors ce processus vertueux se nourrit évidemment d’une meilleure information au sujet des acheteurs d’assurance. Ainsi, par exemple, les témoins de connexion (cookies) dévoilent l’historique de navigation sur Internet. On peut donc savoir en temps réel si l’utilisateur connecté pour demander un devis consulte des sites consacrés aux dispositifs antiradar (mauvais présage pour un conducteur), à la chimiothérapie du cancer du poumon et aux cigarettes électroniques (sinistre augure pour une assurance emprunteur) ou s’il se passionne au contraire pour les chansons scoutes et les balades en forêt. Une exploitation systématique de ces données et des historiques de sinistres par des algorithmes avancés d’« apprentissage machine » révèle les profils de risque avec une finesse jamais atteinte par l’analyse discriminante des données traditionnelles. Peut-être pourra-t-on calculer un jour des primes exactement individuelles. Sans entrer dans la science-fiction, le progrès des méthodes de fouille des données devrait rapidement séparer deux catégories d’assureurs : ceux qui n’ont pas pris la mesure du changement, conservent les mauvais risques et vont au-devant d’une fin ignoble, tandis que ceux qui disposent des technologies avancées prendront un avantage décisif.

Les

Si on considère, par exemple, la synthèse de Crocker et Snow (2013) dans le Handbook of Insurance, ces auteurs montrent que la segmentation est optimale sous deux hypothèses :

- d’une part, les mutualités sont suffisantes ;

- d’autre part, les assurés sont capables de s’auto-sélectionner.

En dehors des hypothèses considérées par les économistes, on mesure l’écart entre le point de vue individuel de l’assureur (ou de l’assuré) et la notion d’efficacité d’économique à l’échelle macroéconomique : les perspectives de profit mirifiques sont le plus souvent illusoires, dans la mesure où elles s’accompagnent d’une telle dégradation de l’efficacité du secteur assurantiel qu’elles sont intolérables du point de vue de l’intérêt général. Il y a fort à parier qu’il sera nécessaire de réguler, tout simplement pour permettre que les risques demeurent assurables, comme il a été nécessaire de légiférer sur les tables de mortalité qui disposent des tarifs minima. À l’heure actuelle, il est encore impossible de dire si l’amélioration des techniques de prédiction ou de révélation du risque propre à chaque assuré conduit vers le monopole ou au contraire vers la fragmentation, car cela dépendra de la distribution des techniques statistiques à venir parmi les acteurs du secteur. Impossible de dire si ce « progrès » permettra encore d’assurer de manière rentable. Tout ce qu’on peut penser, c’est que le « potentiel disruptif » de ces techniques futures dépend de l’amélioration de la précision au sens statistique. À cet égard, il est faux de croire que « plus de données » entraîne nécessairement « plus de clarté ».

Le paradoxe de la quantité de données

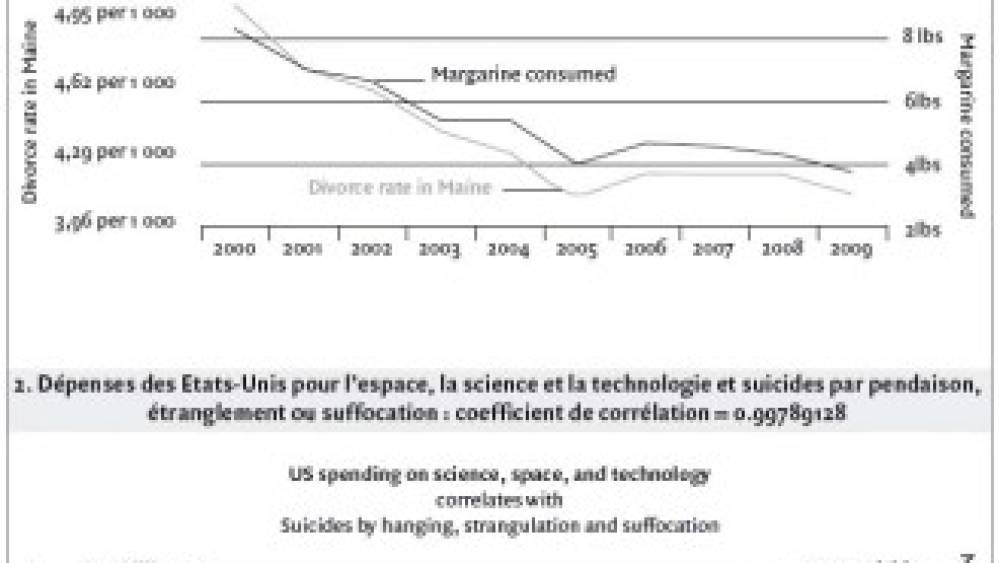

Un livre récent de Tyler Vigen (2015) a popularisé la notion de corrélation spécieuse (spurious correlation), rappelant la phrase d’Alfred Sauvy : « Les chiffres sont des êtres fragiles qui, à force d'être torturés, finissent par avouer tout ce qu'on veut leur faire dire. » Toutefois, le propos de Taylor Vigen prend une dimension anecdotique véritablement hilarante avec une série d’exemples illustratifs (Voir Graphes 1 et 2).

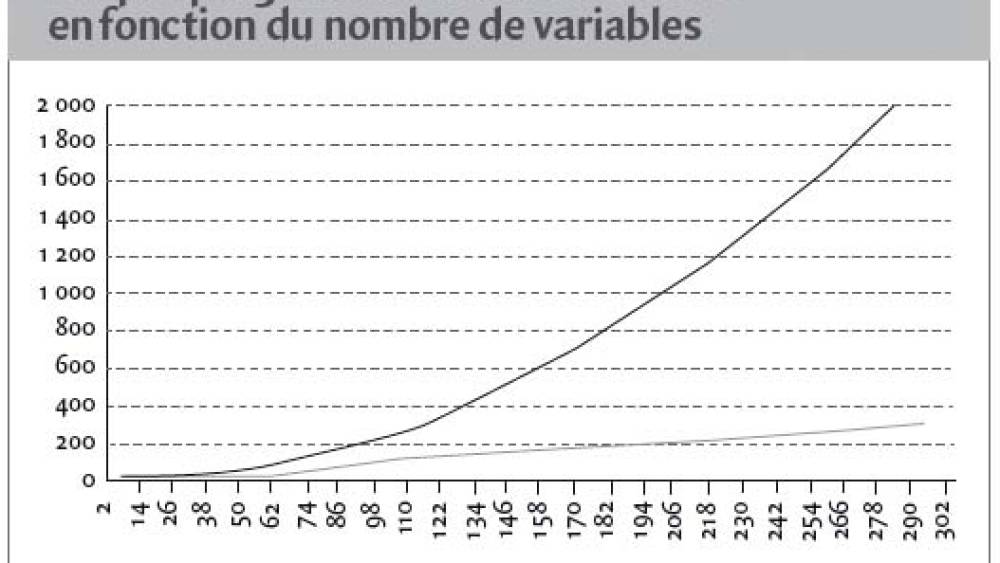

Les corrélations présentées en exemple, avec un coefficient à plus de 99 %, sont statistiquement très bonnes, même si elles sont manifestement dénuées de sens. Ces exemples laissent deviner que, de manière plus générale, plus on a de données, plus on observe de motifs caractéristiques (patterns) qu’on est tenté d’interpréter comme chargés de sens alors qu’ils sont spécieux, suivant le titre de Vigen. Pour comprendre ce phénomène, il faut rappeler la pratique statistique usuelle de considérer comme significatif un test au seuil d’erreur (de type I) de 5 % : cela signifie que pour cent paires d’échantillons de variables aléatoires, cinq apparaîtront en moyenne corrélées… Et plus on considère de variables, plus le nombre de corrélations significatives augmente, non seulement en raison du nombre de variables mais aussi du nombre de combinaisons de variables, lequel est en proportion exponentielle du nombre de variables, comme le montre le Graphique 3 (qui présente à la fois le nombre de corrélations et le nombre de variables, pour montrer l’écart croissant en dépit de la différence d’échelle sur les deux axes) : le nombre de corrélations statistiquement significatives augmente plus que proportionnellement au nombre de variables. Plus on a de données, moins on y verrait clair : Nassim Taleb (2012) argumente brillamment dans ce sens.

On peut objecter que les algorithmes d’apprentissage machine sont bien plus subtils que de simples corrélations, et que les corrélations spécieuses sont un problème typique d’une ère révolue, celle du Small Data, problème que la massivité des données a désormais résolu. Évidemment, les méthodes complexes et spécifiques employées pour la fouille des données massives ne se prêtent pas aisément aux tests d’hypothèses classiques. Mais quelle que soit la nature des motifs caractéristiques, la taille des données ne les rend pas plus robustes à l’erreur puisque la nature même des tests statistiques est d’accepter une hypothèse quand elle n’est pas trop invraisemblable compte tenu des données observées. Aussi la difficulté repérée avec la corrélation se retrouverait-elle avec n’importe quel type de test statistique. Dans le cas du Big Data, il s’avère surtout que les tests ne sont souvent pas faits (étant donné la difficulté pour calculer la vraisemblance), mais cela ne signifie pas qu’ils sont concluants ! Un exemple permettra de convaincre les sceptiques.

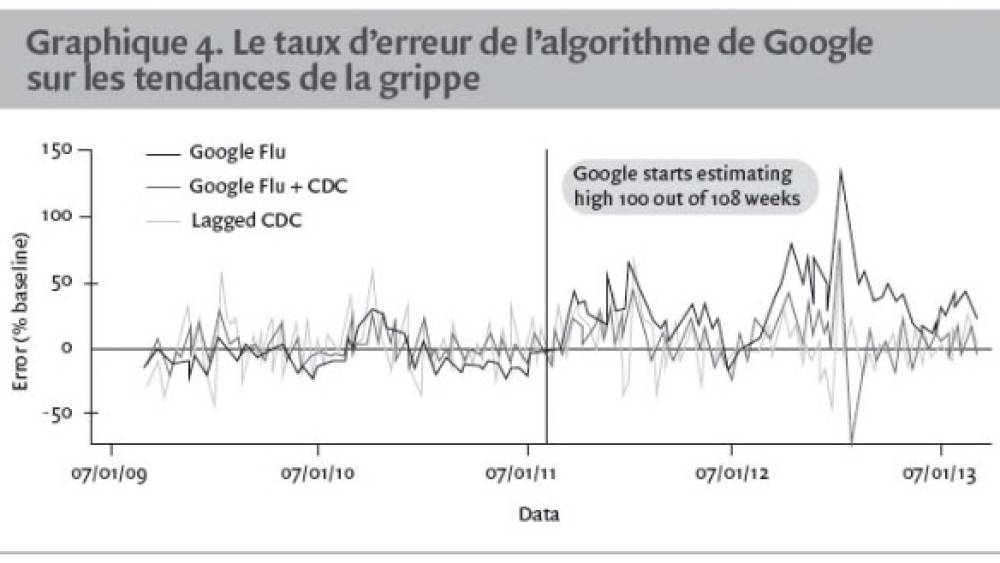

À la fin des années 2000, alors que le terme « données massives » n’était encore connu que des spécialistes, Google rendait publique une expérience importante. Le projet Google Flu Trends (GFT, en français « Google tendances de la grippe ») avait pour objet de prévoir l’irruption des épidémies de grippe à partir des recherches déclenchées par les internautes sur le champ sémantique de la grippe. L’idée était que les internautes seraient d’autant plus intéressés par la grippe, ses symptômes, ses traitements, ses complications que le phénomène les concernerait. Et donc qu’on pourrait faire mieux, plus vite et beaucoup moins cher que les statistiques compilées par le réseau des Centers for Disease Control and Prevention aux États-Unis. L’algorithme de Google avait été testé rétrospectivement sur des données passées (2003-2008) avant que le site google.org/flutrends/ ne soit opérationnel en 2008. Dans un premier temps, on s’émerveille, même si le modèle sous-estime la maladie : l’algorithme est alors recalibré, et il surestime désormais systématiquement la prévalence de la maladie, comme le montre le graphique 4 tiré de Lazer et al. (2014). Cet article, publié après l’arrêt par Google du projet GFT (en février 2013), constitue le rapport du médecin légiste sur cette expérience malheureuse. Malgré tous les moyens que cette entreprise emblématique a mis dans le projet, il n’a jamais été possible de faire mieux, ni même aussi bien, que les statistiques produites par les Centers for Disease Control and Prevention de la manière la plus traditionnelle : enregistrement des cas de grippe rapportés par les médecins, consolidation des données et extrapolation à l’aide d’un modèle statistique simple dont la conception date des années 1960.

Le paradoxe de la quantité des données s’explique simplement quand on comprend que la quantité des données ne supplée pas leur qualité. Les statistiques du CDC sont produites selon une méthodologie uniforme, conçue en fonction des objectifs de description de l’épidémie et de prévision. La constance qui préside à leur élaboration permet des comparaisons dans le temps et dans l’espace et la représentation, certes imparfaite mais utile, des phénomènes. Au contraire, si elle constitue une quantité de données « énorme », la masse des recherches menées sur Internet par des individus divers, et parfois par des robots aux motivations obscures, ne produit pour l’essentiel que du bruit (au sens statistique) dénué d’information. On peut donc penser que c’est – et ce sera – le cas d’une grande partie des données massives : on croit y observer des relations significatives qui s’avèrent finalement insuffisamment précises ou durables pour être exploitées. Mais alors que penser de ces quantités de données nouvelles ? Qu’il convient d’abord de les mesurer…

Le mythe des 90 %

On lit à peu près partout que « 90 % des données de l’humanité ont été créées ces deux dernières années » : la source précise de cette « information » est manifestement perdue dans les 10 % restants, on la cite volontiers pour illustrer la nouveauté radicale des données massives. Dans le meilleur des cas, on ajoute une analyse textuelle des déclarations d’Éric Schmidt (Google) lors de la conférence Techonomy à Lake Tahoe en 2010, ou de Marissa Mayer, avant qu’elle n’aille chez Yahoo! assister au plus grand vol de données de l’histoire (500 millions de comptes utilisateurs piratés)… Depuis, les internautes n’ont cessé de commenter et de recalculer, sans arriver à rien de bien concluant sur l’origine de ces 90 %. Tentons d’éclairer ce chiffre magique.

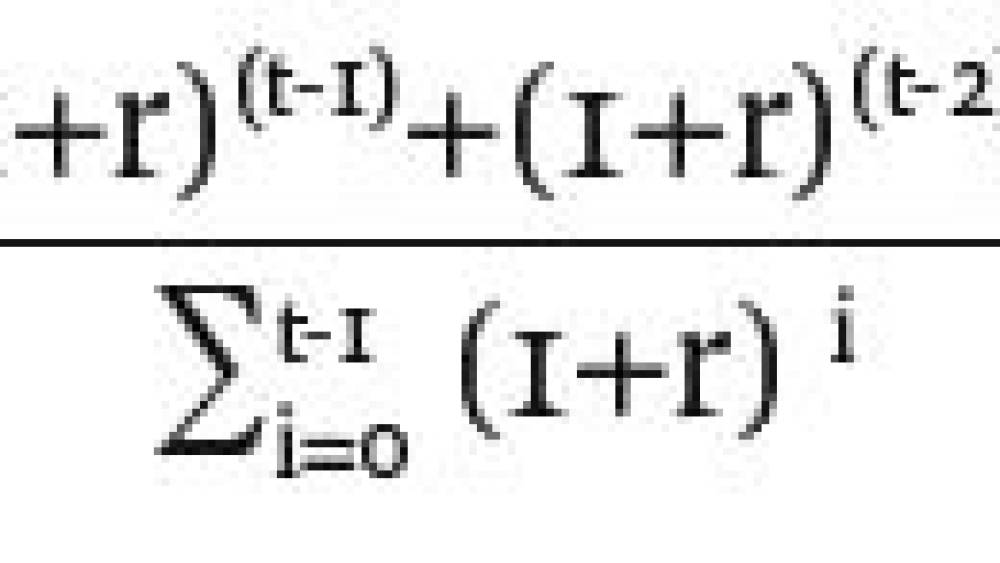

Si l'on considère que l’information produite augmente à un taux constant r, alors à la date t, la proportion des données créées au cours des deux dernières années est tout simplement : voir FORMULE.

Un logiciel de calcul

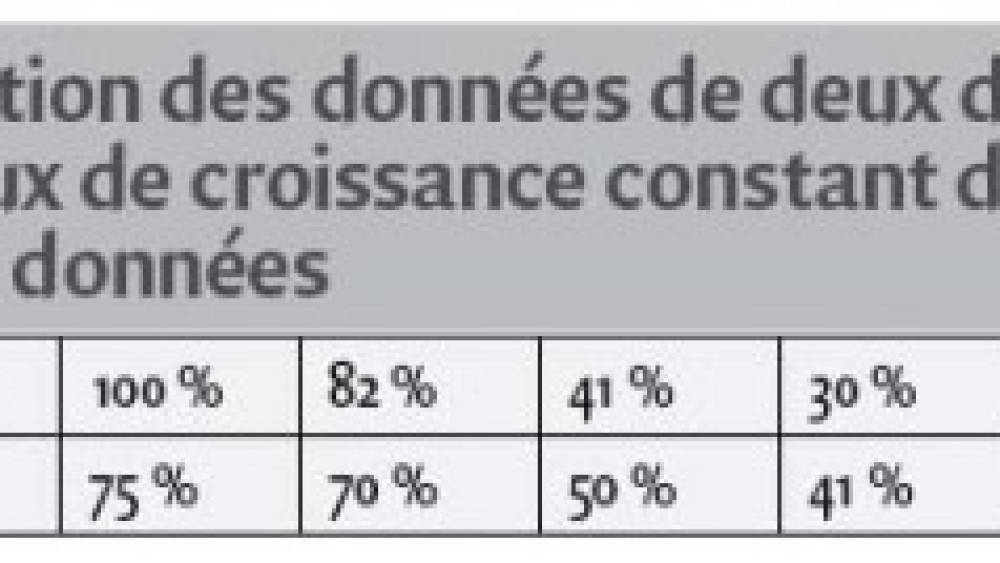

Totalement nouvelle ? En 1965, Gordon Moore, le futur fondateur d’Intel, prédisait que le nombre de transistors dans les microprocesseurs doublerait chaque année. Cette « loi de Moore » fut révisée à la baisse en 1975 : doublement tous les deux ans. Quelques années après, la loi de Kryder considérait que la taille des disques durs augmentait au même rythme, soit un taux de croissance annuel d’environ 41 % (√2 –1). Avec ce taux de croissance, le ratio qui nous intéresse ne vaut plus que 50 % : la masse des informations produites au cours des deux dernières années représente la moitié des informations produites depuis l’origine des temps. C’est encore beaucoup, si on veut ; mais 50/50, c’est déjà neuf fois moins que 90/10.

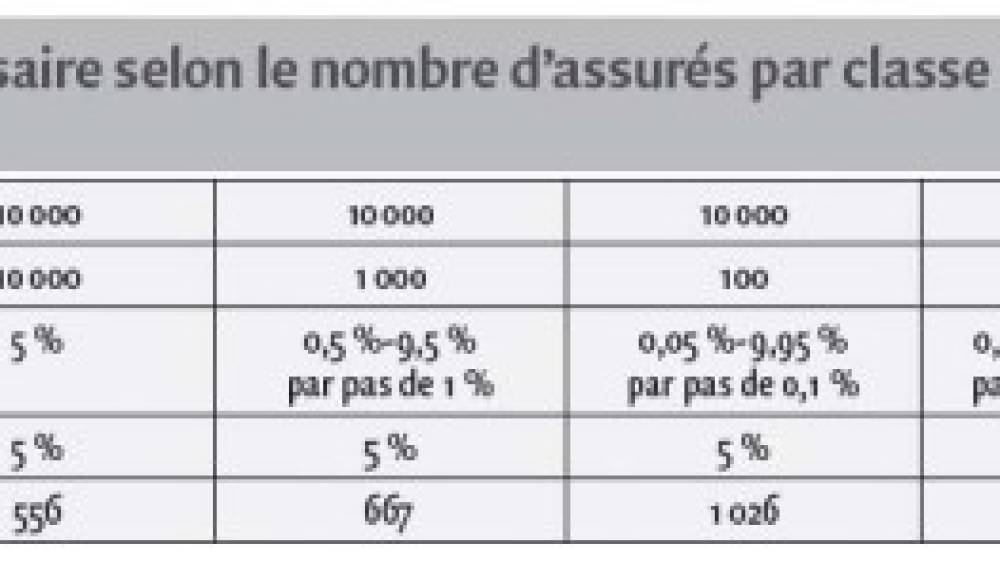

Aujourd’hui, toutefois, nous avons pris du retard sur la loi de Kryder et la loi de Moore semble devoir perdre sa validité à la fin de la décennie, car on ne peut pas produire des éléments de transistors plus petits qu’un atome. Comme il n’est pas possible que la création de données excède durablement son support physique (car les données qui n’existent nulle part… n’existent pas), on peut donc penser que la croissance informatique reviendra à des chiffres plus faibles, tout comme la proportion des données créées « au cours des deux dernières années ». Le Tableau 2 propose quelques estimations du ratio pour divers taux de croissance.

La première colonne « 99,8 % » correspond au « résultat » d’un bloggeur (Leung – 2014) qui prétend avoir montré que la proportion des données créées au cours des deux dernières années était de 99,8 %. Comme le montre le taux de croissance nécessaire pour obtenir ce ratio, un tel « résultat » ressort du comique de l’absurde. C’est précisément ce qui est intéressant dans le phénomène que constitue la répétition universelle du mythique « 90 % ». Une minute de réflexion à partir d’ordres de grandeur devrait permettre de constater que ce chiffre n’est qu’un slogan.

Y voir clair entre le bon usage et les mauvais

Les données massives entraînent des effets non seulement inattendus, mais aussi radicalement opposés à l’opinion colportée par les récits des bonimenteurs. Ainsi, il n’est pas plus vraisemblable que la dynamique de la segmentation aboutisse à l’oligopole des GAFA qu’à la pulvérisation du marché : dans le premier cas, le législateur devrait intervenir pour démanteler l’oligopole, dans l’autre pour fixer un tarif minimum qui permette de reconstituer des mutualités. Dans tous les cas, l’assuré sera plus certainement fidèle à un assureur rassurant que partant pour une aventure incertaine. De manière aussi paradoxale, l’accroissement de la masse des données disponibles n’est pas le gage de l’amélioration de la précision statistique, car les méthodes nouvelles sont trop complexes pour être testées simplement et elles peuvent conduire à se tromper lourdement et durablement, comme l’atteste l’exemple évoqué plus haut de la prédiction de la grippe par Google. Mais alors, comment y voir clair entre le bon et les mauvais usages de ces données massives et des algorithmes pour les traiter ? Le bon sens prescrit d’investir dans le capital humain, c’est-à-dire la formation de tous ceux qui auront à décider des méthodes, afin qu’ils soient armés pour comprendre les évolutions contemporaines. Il faut prendre le temps de former une culture. À cet égard, l’ouvrage de Patrick Thourot (2016) constitue un premier pas dans l’approfondissement des subtilités du Big Data. Quant à ceux qui proposent leurs services et leurs conseils payants, un test simple consiste à leur demander quelle est la proportion des données créée dans les deux dernières années. Vous savez désormais que ceux qui répondent « 90 % » n’ont pas plus réfléchi aux sujets sur lesquels ils ratiocinent que les médecins de Molière : il est donc sage d’ignorer leurs avis.

Références

Charpentier A. (2011), « La loi des grands nombres et le théorème central limite comme base de l’assurabilité ? », Risques, 86.

Charpentier A., Denuit M. et Elie R. (2016), « Segmentation et mutualisation : les deux faces d’une même pièce ? », Risques, 103, 57-61.

Crocker K.J. et Snow A. (2013), « The Theory of Risk Classification », in Dionne G., Handbook of Insurance, pp. 281-313, Springer, DOI 10.1007/978-1-4614-0155-01_11

Harari Y.N. (2016), Homo Deus: A Brief History of Tomorrow, Harvill Secker.

Lazer D., Kennedy R., King, G. et Vespignani A. (2014), « The Parable of Google Flu: Traps in Big Data Analysis », Science, 1203-1205.

Leung L. (2014), « 99.8 Percent of the World’s Data was Created in the Last Two Years » : https ://techexpectations.org/2014/10/23/99-percent-of-the-worlds-data/

Moore G.E. (1965), « Cramming More Components onto Integrated Circuits » (PDF) », Electronics Magazine, p. 4., Retrieved 2006-11-11.

Porrini D. (2015), « Risk Classification Efficiency and the Insurance Market Regulation », Risks, 3(4), p. 445.

Taleb N. (2012), Antifragile, NY, Random House.

Thourot P. et Ametepe Folly K. (2016), Big Data – Opportunité ou menace pour l’assurance ?, RB Édition.

Vigen T. (2015), Spurious Cor relations, NY, Hachette.