L’histoire des organisations à haute fiabilité (High Reliability Organizations), telles que les centrales nucléaires ou les compagnies aériennes, est émaillée d’événements dont la plus récente illustration se trouve être la catastrophe survenue en mars 2011 à la centrale nucléaire de Fukushima, au Japon. Pour assurer leur pérennité, ces industries à haut risque ont su développer une expertise tant dans la maîtrise des risques technologiques que dans celle des risques opérationnels et humains. Selon une estimation de l’

Qu’est-ce qu'une organisation à haute fiabilité ?

Le concept de Haute Fiabilité organisationnelle (HFO) est né aux États-Unis, suite aux travaux précurseurs d’Allison (1971) sur la crise des missiles de Cuba, avant d’être théorisé au début des années 1980 par des chercheurs de l’Université de Berkeley. À l’origine, ce concept s’appliquait à toutes les formes d’organisation intervenant dans des secteurs dits à haut risque – tels que la défense, le nucléaire ou l’aéronautique –, avant d’être étendu à d’autres formes d’activités, comme l’assurance ou la santé (voir Encadré 1). Les organisations à haute fiabilité se caractérisent par une structure opérationnelle complexe et un environnement à la fois incertain et menaçant, toute défaillance organisationnelle pouvant conduire à des catastrophes humaines ou environnementales.

À ce titre, deux perspectives s’affrontent. Dans la première, les comportements des acteurs peuvent être compensés par une organisation efficace centrée sur la sécurité et la fiabilité des opérations. Des procédures adaptées de contrôle des risques ainsi qu'une culture organisationnelle forte couplée à un système performant de simulation des incidents doivent encourager la prise de décision et favoriser les retours d’expérience, afin d’anticiper la survenance des risques et modifier les procédures existantes. Dans la seconde perspective, les accidents majeurs sont inévitables quelles que soient les procédures de contrôle mises en œuvre, en raison du caractère intrinsèquement complexe du risque technologique ou humain non prévisible. À cela s’ajoutent des logiques d’acteurs parfois contradictoires, qui peuvent aller à l’encontre de l’objectif fondateur de fiabilité et de sûreté au cœur du fonctionnement de ces organisations.

Les banques : des organisations complexes à haut risque ?

La faillite de Lehman Brothers et les affaires récentes qui ont émaillé les activités de trading de certaines grandes banques françaises illustrent précisément l’existence d

- La complexité intrinsèque des opérations : l’imbrication des systèmes d’information, la volumétrie des opérations et la technicité de certains produits financiers limitent la capacité des banques à anticiper les risques majeurs en raison de la spécialisation des acteurs et de la responsabilité parfois diffuse du contrôle opérationnel entre les différentes activités bancaires.

- La dynamique propre des processus : l’exposition des banques à certains types de dysfonctionnements opérationnels (défaillances, erreurs d’exécution, fraudes, dommages) communs à des activités cloisonnées favorise la propagation des risques au sein de l’organisation, indépendamment de toute action humaine, sans retour possible à un état antérieur.

- L’environnement de contrôle : la réglementation et l’action des autorités de contrôle agissent directement sur le dimensionnement des systèmes de contrôle interne et sur l’application de procédures d’alerte (ratio d’exigence de fonds propres, ratio de liquidité, plan de continuité d’activité). Le rôle et le dimensionnement des autorités de contrôle bancaire (ACP) et nucléaire (ASR) sont ainsi relativement semblables (voir Encadré 2).

Des systèmes de contrôle des risques opérationnels comparables

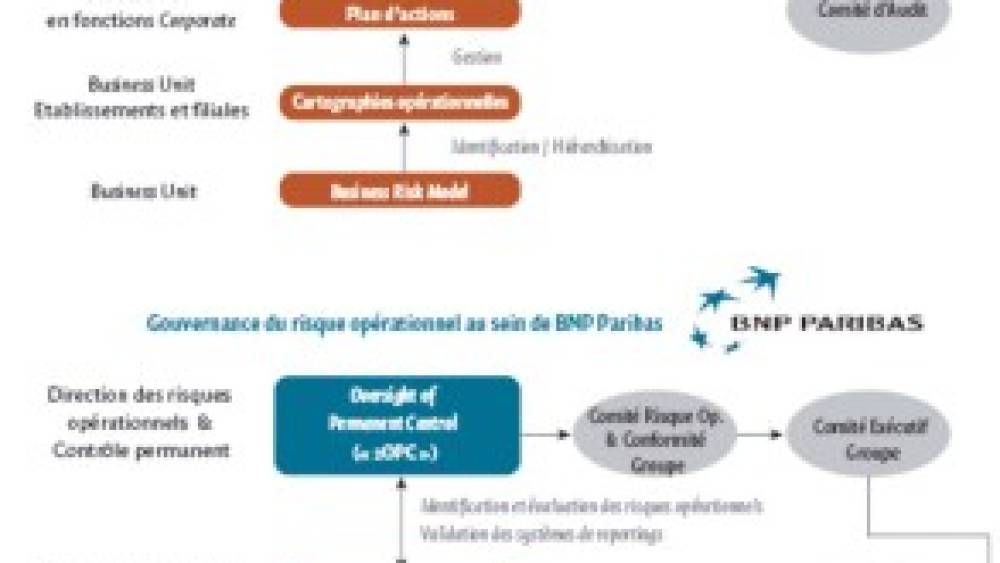

En matière d’organisation du contrôle interne des risques opérationnels, les établissements financiers se rapprochent également des organisations de type HFO ; les banques cherchent à atteindre trois objectifs majeurs communs avec les industries à haut risque (voir Encadré 3) :

- identifier et mesurer les risques opérationnels à travers la mise en place d’outils spécifiques (cartographie et modélisation des risques, procédures d’encadrement du personnel, déploiement des process vers des solutions informatiques adaptées) ;

- formaliser, détecter les incidents et contrôler le dispositif de risque par une forte séparation des tâches, une gestion des droits d’accès limités ou des politiques de limites encadrées (gestion des délégations) ;

- prévenir les risques majeurs et les anticiper par des plans d’action idoines (VaR de risques opérationnels, plan de continuité d’activité…).

Afin d’illustrer ces propos, l’initiative récente des grandes banques françaises – parmi lesquelles BNP Paribas, Société Générale et Natixis –, qui ont mis en place des projets d’amélioration de l’efficacité opérationnelle en utilisant des méthodologies de cartographie ou dérivées de Lean 6 Sigma, est particulièrement intéressante. Ces programmes permettent de dresser une cartographie des principaux processus et de leurs faiblesses majeures. Par la suite, ces travaux ont constitué une base de référence pour identifier les risques opérationnels en tant que défaillance des processus, mais à ce jour ils ne semblent pas encore être utilisés comme référentiel de point de contrôle des risques.

Stress tests et simulation des incidents

L’autre trait commun entre le mode de prévention des risques au sein des banques et des organisations de type HFO réside dans l’utilisation de stress tests permettant de simuler des scénarios de crise. Historiquement, les premiers tests de scénario sont apparus dans les industries nucléaire et aéronautique afin de simuler des dysfonctionnements techniques ou les conséquences d’attaques terroristes ou d’épidémies. Dans le cadre des stress tests réalisés sous l’égide du Comité européen des régulateurs, dès 2008, des tests spécifiques aux risques opérationnels ont été menés par les banques en se fondant, d’une part, sur l’identification d’événements générateurs de pertes (loi de probabilité en fréquence) ou de défaillance de processus (loi de probabilité en sévérité), et d’autre part, sur une modélisation des risques par un

Quelles leçons tirer pour les banques ?

Afin d’anticiper de nouveaux chocs liés à la survenance de risques opérationnels et limiter le niveau d’exigence des fonds propres, les banques et leurs autorités de tutelle ont tout intérêt à se rapprocher des best practices des organisations à haute fiabilité. Ainsi, une des inspirations pourrait provenir de la méthode utilisée dans l’industrie nucléaire intitulée

Le projet

Tout d’abord (I.), il s’agit de passer d’une approche par processus ou par activité (approche en silo) à une approche intégrée du contrôle des risques opérationnels fondée sur une filière risque (approche transversale) ; puis (II.) de créer une nomenclature et un référentiel standardisés de points de contrôle des risques opérationnels (Bâle II), par la conception d’un référentiel commun à l’ensemble des établissements bancaires. Le projet prévoit également (III.) de développer une métrique de score et un indicateur global de risque opérationnel (KRI) destiné à apprécier la qualité du contrôle interne d’un établissement et favoriser le benchmarking entre banques (à l’image de l’airmiss utilisé comme base d’incident dans le transport aérien). De plus, il propose (IV.) de systématiser l’utilisation de stress tests sur la base d’incidents opérationnels avec un objectif d’évaluation des méthodologies par un organisme externe compétent (à l’image d’Eurocontrol qui valide les plans de simulation des risques d’incidents des compagnies aériennes). Il renforce (V.) l’approche du risque opérationnel fondée sur le facteur humain, de manière à encourager l’apprentissage organisationnel et le retour d’expérience ; il favorise (VI.) le développement de bases de données d’incidents partagées entre les banques, comme la