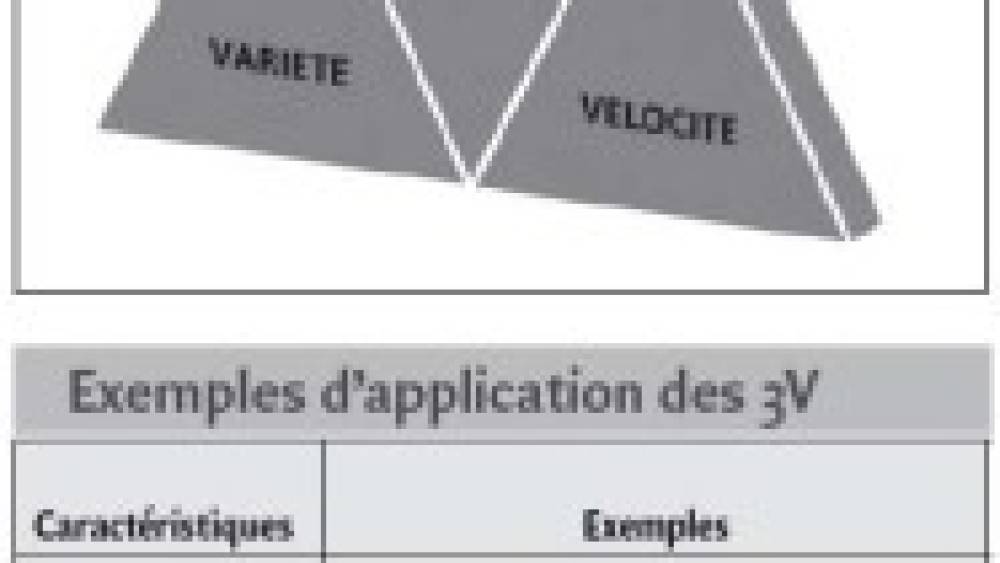

Les entreprises d’assurance font face, depuis quelques années, au développement du Big Data. Il correspond à un afflux massif de données, structurées ou non, provenant de sources multiples, diverses et variées et se caractérise par la réunion des 3 V (Volume, Variété, Vélocité) créateur de l’indispensable « valeur » pour l’entreprise (voir Schéma).

Créé à partir des informations fournies par leurs clients, le vivier de données à disposition des entreprises d’assurance est conséquent. L’utiliser est un critère différenciant et le faire à bon escient peut constituer un avantage concurrentiel déterminant.

Cet afflux de données nécessite de repenser les systèmes informatiques mais aussi les techniques de conception et de tarification. Les algorithmes comportementaux prédictifs se développent ainsi avec les récents progrès informatiques et s’enrichissent de nouveaux critères et variables. Ils permettent ainsi de sortir de la classique régression GLM utilisée pour le calcul du risque et de le modéliser ou l’analyser par un prisme plus varié et complet.

De nombreuses innovations récentes et le progrès technologique modifient également en profondeur les modèles économiques des acteurs du marché. Avec l’émergence de nouveaux risques tels que le risque cyber, le développement du véhicule autonome ou la multiplication des catastrophes naturelles, les modèles économiques sont remis en question et nécessitent une évolution des contrats d’assurance et des garanties proposées aux clients.

Un véritable écosystème de nouvelles entreprises s’est récemment construit autour des informations collectées par les entreprises d’assurance ou les banques pour en saisir la valeur ajoutée. Celle-ci réside principalement dans son stockage, son traitement et son analyse.

Idéalement positionnés dans la chaîne de valeur du secteur, les assureurs bénéficient d’une certaine légitimité pour procéder à l’extraction des renseignements utiles de leurs bases de données. Cependant, les compétences techniques dans ce domaine sont rares et l’intérêt pour la Data Science (la science des données), un domaine auquel les entreprises d’assurance commencent tout juste à s’intéresser, est encore embryonnaire. Leurs craintes, réelles ou virtuelles, et leurs appréhensions, fondées ou non, ont retardé un grand nombre d’acteurs dans le développement d’une stratégie digitale et informatique réellement compétitive voire disruptive.

Face à l’apparition de nouveaux risques et au développement de nouvelles garanties, les entreprises d’assurance ont cependant été contraintes d’accélérer la diffusion de leurs services et d’engager de réelles stratégies globales de digitalisation, afin de ne pas être irrémédiablement distancées par les nouveaux entrants.

Le calcul actuariel du risque

La masse d’informations issues du Big Data modifie substantiellement l’approche actuarielle et le calcul du coût du risque des assureurs. En effet, les données à disposition des actuaires transforment l’approche tarifaire et permettent d’accéder à une nouvelle segmentation. La finesse des statistiques et la variété des données disponibles et fournies, entre autres, par les objets connectés permettent de créer des mutualités plus homogènes, liées par de nouvelles lois comportementales afin de modifier les primes et tarifs mais aussi d’intervenir et d’ajuster plus globalement les équilibres financiers tels que le

Au niveau du client, on s’approche d’une vision plus centrée sur ses besoins avec le Customer Centric et l’avènement du « Consom’acteur », comme l’expliquent MM Thourot et Ametepe Folly dans leur ouvrage Big Data : Opportunité ou menace pour

Les méthodes prédictives

La tarification des contrats est un enjeu majeur pour l’ensemble des entreprises d’assurance. L’objectif des méthodes prédictives consiste à expliquer ou prévoir un ou plusieurs phénomènes observables et effectivement mesurables. L’évaluation de la probabilité de souscription d’un contrat spécifique, l’appréciation d’une stratégie digitale suite au lancement d’un nouveau service ou site internet, les prédispositions génétiques ou comportementales de contracter une maladie sont quelques objectifs que les méthodes prédictives cherchent à atteindre.

Après avoir vu que la variété et le volume des informations étaient indispensables pour créer de la valeur à partir de ces bases de données, l’aspect qualitatif est également primordial. En effet, toutes les informations n’ont pas la même utilité ni le même potentiel. La qualité des données est alors définie par leur degré d’adéquation selon l’usage auquel elles sont destinées. Ainsi, Wang et Strong ont défini 179 dimensions pour mesurer la qualité des

Pour évaluer ce critère « qualité » et pour classer ces 179 dimensions, six familles de dimensions ont été constituées. Elles portent sur l’exactitude, la complétude, les dimensions temporelles, la confiance, la pertinence et l’unicité des données.

Certaines dimensions seront objectives telles que la complétude ou l’exactitude des données, d’autres nettement plus subjectives comme les dimensions relatives à la confiance ou à la pertinence des données.

Toutes seront cependant corrélées entre elles. Cette dépendance des dimensions peut donc entraîner une variation de la qualité de certains critères selon que l’on souhaite améliorer l’une des dimensions au détriment d’une autre. L’analyse de la qualité des données peut ainsi être plus globale en ajoutant, outre la qualité des données, celle des sources dont elles sont issues, des processus ou enfin des modèles.

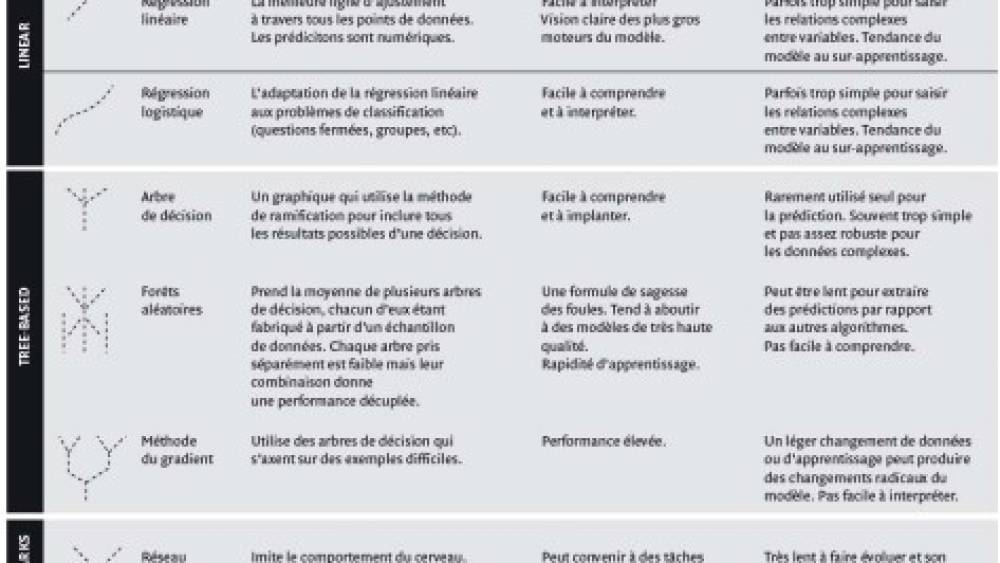

Dans son ouvrage sur les enjeux du Big Data, Christophe Brasseur relève qu’on distingue « deux types d’opérations : la discrimination (ou classement) et la régression (ou prédiction) selon le type de variables à expliquer. La discrimination s’intéresse aux variables qualitatives tandis que la régression s’intéresse aux variables continues. De nombreux modèles se basent sur les principes des méthodes prédictives tels que les arbres de décision, les réseaux de neurones ou encore le filtrage collaboratif utilisé en marketing pour construire des systèmes de recommandation dégageant les opinions ou évaluations d’un

Les outils statistiques

Les outils de modélisation statistique se sont développés et permettent une analyse tarifaire fine et précise des équilibres financiers de chaque produit d’assurance. Les plus connus sont les logiciels Open Source R & PYTHON.

Considérés comme particulièrement performants grâce à leurs capacités de traitement d’importants volumes de données, leurs avantages graphiques sont nettement supérieurs à leurs concurrents directs et la qualité de leurs bibliothèques ou leur facilité d’utilisation en font des outils indispensables pour l’analyse tarifaire. Ils bénéficient également d’une communauté particulièrement active pour le développement de nouvelles fonctionnalités.

Le logiciel SAS, quant à lui, est reconnu dans le domaine de l’éditique de rapports et regroupe une large gamme des méthodes d’analyse statistique. Outre ses capacités d’évolution grâce à des modules additionnels, un de ses principaux avantages réside dans la programmation de procédures ad hoc.

Les algorithmes prédictifs

Régressions linéaires selon les méthodes Partial Least Squares ou General Linear Models, arbres de décisions et forêts aléatoires, mais aussi réseaux neuronaux sont les principaux modèles algorithmiques issus des méthodes prédictives et de l’apprentissage supervisé.

Utilisés dans des processus de classement ou de prédiction, ils permettent d’expliquer des variables « cibles » Y à partir d’autres variables X dites « explicatives ». L’algorithme permet alors

de générer une fonction f afin de reproduire l’input Y à partir de l’observation des variables X observées grâce à des critères visant à minimiser l’erreur de prédiction comme celui du Mean Square Error (MSE). Le processus d’apprentissage se poursuit jusqu’à ce que l’algorithme atteigne le niveau de précision désiré par rapport aux données issues de la base.

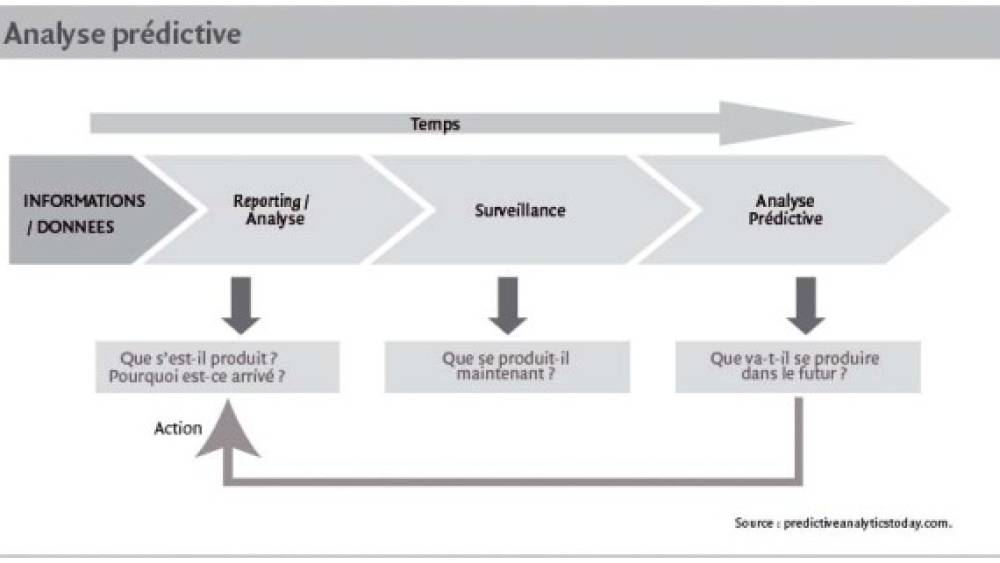

L’analyse prédictive s’appuie à la fois sur la modélisation prédictive et sur la prévision.

Si les modèles prédictifs permettent de répondre à des questions du type « qui ? quand ? et pourquoi ? » sur la base d’objectifs très concrets, par exemple l’analyse des risques de churn (passage de la clientèle à la concurrence), les prévisions répondent plutôt à des questions du type « combien ? » permettant l’anticipation de tendances.

Le marketing a ainsi été précurseur dans l’utilisation et le développement des méthodes d’analyse prédictive. Aujourd’hui, l’assurance applique ces techniques, notamment dans la lutte anti-fraude, et permet le développement de son potentiel considérable.

Les opportunités du Data Mining

Ciblage comportemental, maintenance prédictive, analyse des réseaux sociaux ou fidélisation des clients sont autant d’opportunités stratégiques offertes à l’entreprise d’assurance.

Le Data Mining, allié au Machine learning, décuple ainsi les relais de croissance dont disposent les sociétés d’assurance pour affiner leur connaissance des souhaits et besoins de leurs clients.

Grâce au réservoir d’informations dont elle dispose, l’entreprise d’assurance utilise l’analyse temps réel issue également de la multiplication des objets connectés.

Véritable relais de croissance, la connaissance client est facilitée par le Data Mining. Celui-ci s’applique principalement à trois domaines :

- le risk management grâce à la baisse de la sinistralité et l’exclusion de certains risques avec l’élaboration et l’affinage des modèles prédictifs ;

- une meilleure identification des besoins d’équipement, un meilleur conseil commercial avec un accroissement du cross-selling et une personnalisation du parcours client ;

- l’optimisation de la gestion des indemnisations et l’amélioration de la détection des fraudes.

Les perspectives de l’analyse prédictive

Les modèles algorithmiques vont continuer à évoluer et s’améliorer notamment dans leurs capacités à capter et à organiser les variables. Face à cet afflux de données, les systèmes d’information (SI) et les systèmes de gestion de bases de données (SGBD) améliorent leurs moyens d’analyse et de traitement de ces données non structurées.

C’est cette rétro-propagation et ce processus itératif qui amélioreront constamment l’analyse prédictive en s’appuyant sur le catalogue de données à disposition de l’assureur.

Toutefois, un des inconvénients réside dans le fait que ces nouvelles données risquent d’exclure une population suffisamment importante pour remettre en cause le principe de mutualisation de l’assurance.

En effet, si dans certains secteurs cette analyse prédictive peut être porteuse de valeur ajoutée, dans d’autres, notamment la santé, le développement des algorithmes génétiques et la sélection de risques mieux identifiés peuvent s’avérer discriminants et exclure une importante partie des assurés potentiels. Si elle était poussée à son paroxysme, cela pourrait remettre en cause un des principaux piliers de l’assurance et sa raison d’être à savoir : protéger le plus grand nombre d’individus. On assisterait ainsi à une stigmatisation de certaines populations à risques (obésité, maladies chroniques ou affections longue durée, etc.) les excluant alors du marché assurantiel.

Pour prévenir de telles dérives, le contexte réglementaire est lui aussi en pleine évolution. Afin d’éviter toute discrimination ou toute dérive commerciale basée sur des informations recueillies en dehors d’un cadre bien délimité, la loi pour une République numérique et le règlement pour la protection des données ont été récemment adopté. Ce dernier règlement européen entrera en application le 25 mai 2018. Il unifie le cadre juridique au niveau européen, favorise l’encadrement des sanctions et renforce le droit des personnes. Basé sur la transparence et la responsabilité, ce règlement précise et allège les formalités administratives. De nouveaux outils de conformité et de nouveaux concepts émergent comme le Privacy By Design et le Privacy By Default. Enfin, il consacre la nécessaire protection des données personnelles et définit précisément les informations à caractère médical.

Au niveau de l’entreprise d’assurance, il apparaît nécessaire d’expérimenter les solutions d’intelligence artificielle (IA) tels que les réseaux neuronaux dans la voiture autonome. Ces solutions augurent d’une transformation profonde des modèles économiques et préparent à une (r)évolution de la responsabilité et des positions des acteurs, notamment dans l’assurance automobile. Une réflexion a d’ailleurs été lancée vendredi 9 septembre par le Premier ministre Édouard Philippe en visite au

D’autre part, l’Open Data apparaît comme un outil en plein développement destiné à perfectionner les algorithmes au bénéfice des entreprises et de leurs structures commerciales. Dans un mode collaboratif et participatif, cet accès à des données ouvertes et gratuites permet d’enrichir la connaissance client. La relation commerciale et la gestion de la clientèle redeviennent la pierre angulaire d’un développement raisonné de la Customer Life Time Value (CLTV) et le terrain privilégié pour le lancement de nouveaux produits ou garanties.

Enfin, si les outils évoluent, les méthodes et les processus managériaux doivent également s’adapter aux nouvelles technologies. Ainsi, pour maintenir ces avantages concurrentiels, il apparaît indispensable de sortir des modèles traditionnels et d’affiner la connaissance client grâce aux outils informatiques. La pertinence et la qualité des catalogues de données seront alors des critères différenciants et déterminants pour évaluer la juste prime et le tarif technique idoine pour chaque contrat d’assurance.