Nous proposons d’analyser les avancées concrètes autour de l’exploitation la Data en 2021 : entre innovations technologiques et transformations organisationnelles, comment la gestion des risques se modernise-t-elle au sein des banques ?

Quels chantiers Data essentiels face à ces nouvelles exigences ?

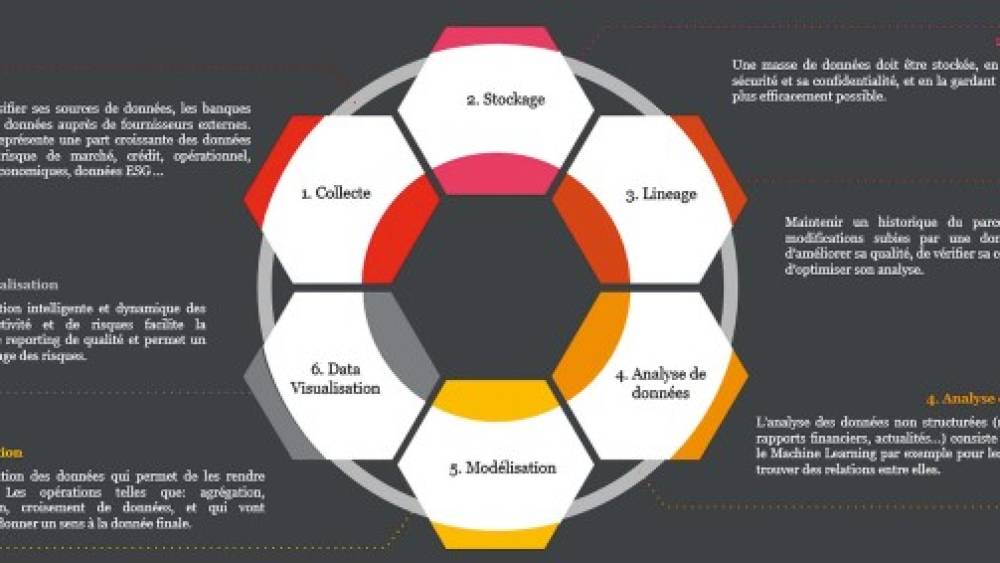

Afin de se conformer à ces exigences inédites et développer leur pilotage des risques, les banques doivent traiter six chantiers Data (voir Schéma 1) :

– la collecte : multiplier les sources et les types de données utilisées ;

– le stockage : conserver une masse de données historisées, pouvoir y accéder rapidement et avec un maximum de sécurité ;

– le lineage : avoir un suivi clair du chemin et de la vie de la donnée. Le lineage est essentiel pour comprendre et interpréter les données ;

– l’analyse de données : utiliser les nouvelles technologies comme le Machine Learning pour exploiter tous types de données et réussir à trouver des relations entre elles, e.g. entre données structurées et non structurées, entre données internes et données externes… ;

– la modélisation : agrégations, transformations, croisements de données, autant d’opérations qui donne un sens à la donnée finale et la rend exploitable ;

– la Data Visualisation : afficher de façon claire et ergonomique les analyses et les métriques de suivi des risques : la dernière étape qui permet à la Direction des risques et au Management un pilotage efficace des risques et une prise de décision juste et rapide.

L’intelligence artificielle au cœur de solutions toujours plus innovantes

Les solutions innovantes foisonnent actuellement au cœur de ces six chantiers. Où en est--on quant à l’utilisation de l’Intelligence artificielle (IA) ?

L’intérêt de l’IA est double : son pouvoir prédictif et sa capacité de classification des données. Le Machine Learning (ML) peut reproduire les tendances des données passées et ainsi anticiper des valeurs futures, ce qui permet d’identifier des valeurs statistiquement aberrantes ; il peut également repérer des relations entre des données de types variés et ce de façon plus pertinente à mesure que l’algorithme apprend du choix et des rejets de relations effectués par une main humaine. Fabien Schricke, Responsable RISQ/CTL (responsable du contrôle Niveau 2) au sein de la Direction des risques du groupe Société Générale, nous donne un exemple de lien entre deux données très différentes et pourtant potentiellement liées : l’ampleur des pertes opérationnelles et le mois de l’année. Avec la masse de données brassées aujourd’hui, les algorithmes de ML ont un immense potentiel dans le repérage de ce type de relations et autres signaux faibles.

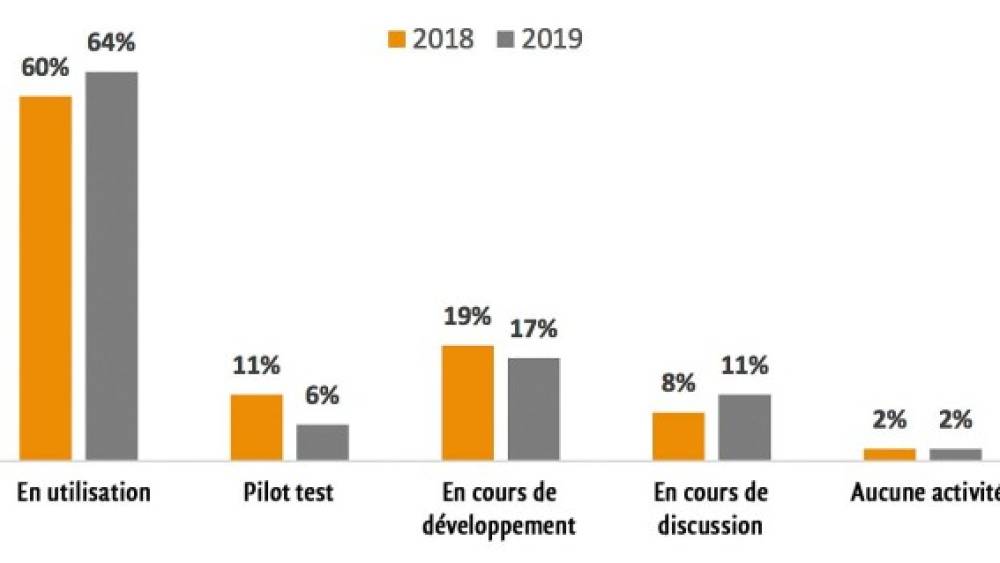

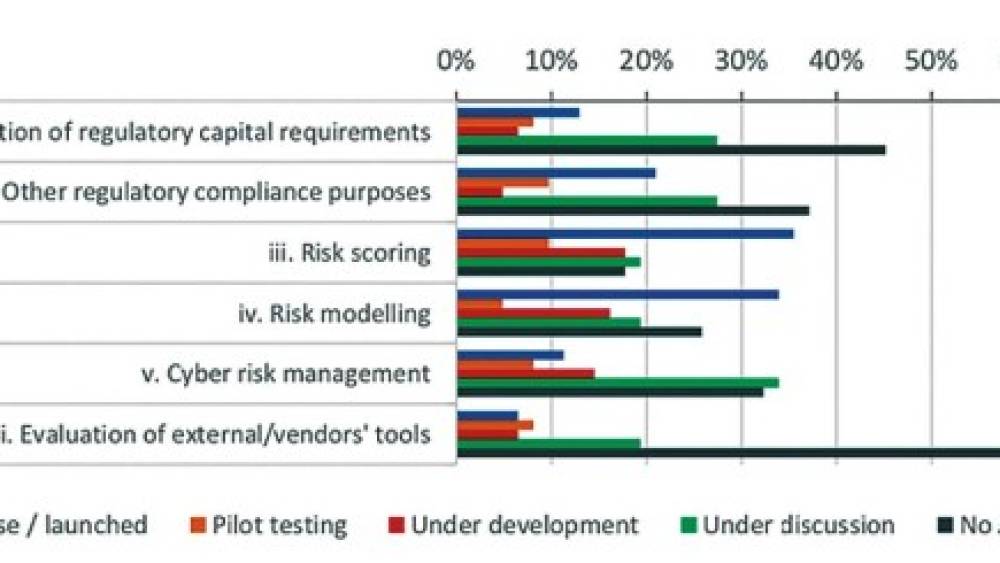

Selon un rapport de l’Autorité Bancaire Européenne de 2020 (voir graphiques 2 et 3), l’utilisation par les institutions bancaires de techniques analytiques avancées (ML, IA…) devient une réalité. Près de 64 % d’entre elles déclarent avoir déjà lancé des solutions ayant recours à ces avancées technologiques dans le cadre de la gestion des risques.

L’IA s’applique en fait sur l’ensemble des six chantiers Data vus précédemment, en voici quelques exemples (cf. Schéma 4) :

– l’analyse de données : la détection anticipée d’évènements de crédit à l’aide d’outils de negative news comme Factiva ou encore des algorithmes de webscrapping auto-apprenants pour déceler sur internet des évènements générateurs de risques ;

– le stockage intelligent de données : permet d’accéder plus rapidement aux données selon leur fréquence d’utilisation. Insight Edge de GigaSpaces arbitre entre les différents supports de stockage (RAM, SSD et HDD) selon la fréquence d’utilisation d’une donnée. Cette technologie est utilisée par des BFI en France et à travers le monde.

Des outils performants qui couvrent l’ensemble de la chaîne de valeur de la data

Voici des domaines où les solutions Data ont largement et concrètement progressé ces dernières années :

Les outils de Data Visualisation : l’utilisation de QlikSense, Tableau, PowerBI, etc., s’est très largement répandue à travers les banques. Ils facilitent la lecture de métriques complexes par leur visualisation intuitive et dynamique. Ces solutions permettent aussi des analyses prédictives de dynamiques qui se révèlent utiles tant à l’égard du régulateur, que dans le cadre du pilotage des risques.

L’une des leçons que l’on tire du succès de ces solutions est que l’expérience utilisateur est essentielle pour faciliter l’adoption d’un outil par les opérationnels. Un outil peut rassembler toutes les fonctionnalités recherchées, il se révèlera inutile s’il n’est pas ergonomique. Et ce pour une raison très simple : les utilisateurs métiers ne sont pas, pour la plupart, informaticien ou statisticien. Fabien Schricke souligne : « rendre les outils user friendly est essentiel pour assurer la démocratisation des solutions Data ». Des écrans où l’on doit saisir des lignes de code seront réservés uniquement à un type d’utilisateurs bien précis, familier des environnements techniques.

Les Datalakes, vers un SI Data Centric : un SI Data Centric est un SI où les référentiels et les flux de données sont organisés avec une source de données unique de référence. Une réussite encourageante dans ce sens réside dans le développement récent des Datalakes : centraliser l’ensemble des données Golden Source dans un lieu unique de stockage et de distribution. Les Datalakes doivent être accompagnés d’une cartographie des données avec leurs définitions, leurs règles de calcul et tous les éléments nécessaires à leur Lineage (cf. Data Galaxy Figure 4). C’est ici que viennent se brancher un maximum d’applications à travers un groupe bancaire, et que disparaissent peu à peu les silos de données entre entités ou activités. Cela évite les doublons ou encore les incohérences de méthodes de calcul d’une même métrique entre deux applications.

Les Datalakes vont de pair avec une solution Cloud : Face à la quantité massive de données que les banques sont amenées à manipuler, l’utilisation de solutions Cloud privé ou public a gagné du terrain. Bien utilisé, le Cloud public permet d’optimiser les coûts et les performances. Amazon Web Services et Microsoft Azur sont les deux géants du marché, mais une multitude d’acteurs se complètent en fournissant des solutions différentes : le Cloud ne concerne pas uniquement le stockage de données à distance, c‘est aussi de l’infrastructure, des réseaux, des environnements, des applications, des services à valeur…

Le lineage : les outils deviennent plus simples et leur utilisation se généralise sous l’impulsion des exigences BCBS239, avec des solutions avancées comme Colibra ou encore Data Galaxy qui permettent à travers une interface user friendly de mieux piloter le cycle de vie des données et leurs parcours dans le système d’information (cf. schéma 4).

Une implémentation opérationnelle souvent complexe

Le déploiement d’une solution démarre généralement par un POC (Proof of Concept) afin de démontrer au travers d’un cas d’usage la valeur créée sur un périmètre restreint. En cas de succès, la seconde étape consiste à procéder à l’industrialisation de cette solution à l’échelle de la banque. C’est en général à cette étape que des obstacles d’implémentation apparaissent. En premier lieu, la difficulté réside dans le processus de migration depuis l’écosystème applicatif existant vers la solution cible. Un haut niveau de confiance est nécessaire avant de débrancher le Legacy, l’ensemble des usages et les flux d’alimentation SI doivent être précisément cartographiés afin de ne rien oublier au moment de la migration.

Un autre obstacle que nous partage Christophe Sauthon, responsable des référentiels Groupe à la Société Générale, concerne le passage du POC à une solution industrielle qui nécessite de faire des choix importants en termes de gouvernance, de budget, de sponsors et de déploiement opérationnel. En effet, l’adaptation d’une solution, réussie à l’échelle d’un POC, à l’architecture de chaque business line implique une transition technique et opérationnelle parfois pour des milliers d’utilisateurs, ce qui nécessite des moyens importants.

Et même lorsque les moyens sont alloués, d’autres difficultés d’implémentation apparaissent. Le Lineage en offre une bonne illustration. Des outils de Data Lineage scannent tout un SI et tracent automatiquement les « graphs spaghettis » du chemin de la donnée. En pratique, deux problèmes se posent : les outils en question ne savent pas lire tous les langages de programmation et les graphs ont à ce stade un niveau de complexité tel que le lineage est illisible et perd son sens. Sous l’impulsion de BCBS239, qui impose le lineage complet de certaines données critiques, des travaux ont été lancés et des rapports produits, mais le résultat obtenu reste à ce jour globalement insuffisant, surtout du fait de la complexité du SI et des flux de données.

Des modèles organisationnels qui favorisent la transversalité

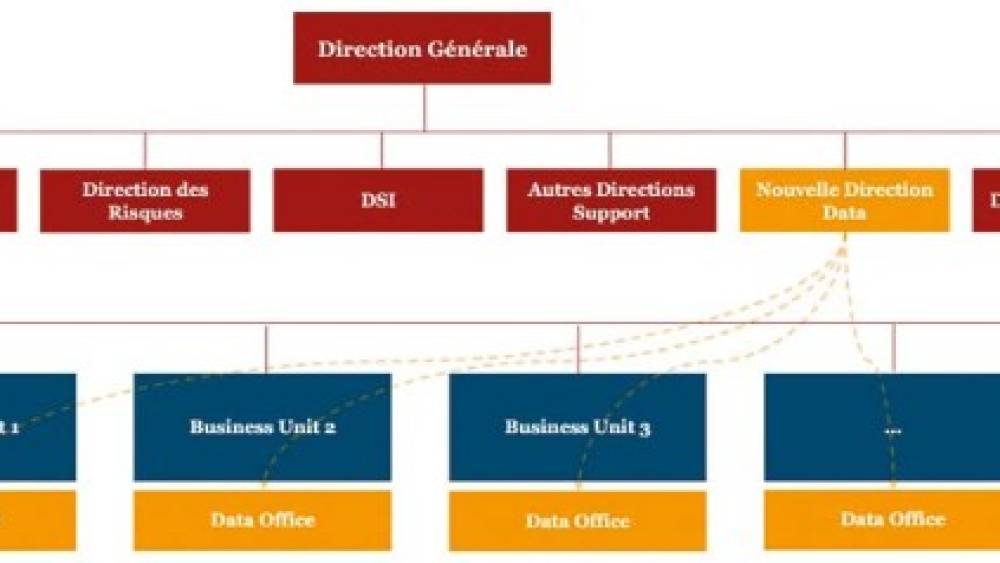

La transformation Data est une transformation technologique mais aussi une transformation organisationnelle. Il apparait essentiel d’avoir une direction dédiée à la gouvernance des données et à l’outillage Data afin de définir et de tenir des objectifs moyen/long terme, d’assurer la pérennité des transformations et de centraliser les besoins des différentes directions et Business Line. Les banques ont donc créé une Direction Data ayant un rôle transverse, avec à sa tête, le Chief Data Officer (cf. schéma 5).

Comment s’articule les responsabilités autour de la gestion de la donnée ? Et comment accompagner l’ensemble des collaborateurs vers une acculturation Data ?

• Des Data Offices au sein de chaque Business Line transmettent à la Direction Data leurs besoins fonctionnels critiques et s’assurent en retour du respect des bonnes pratiques Data (cf. figure 5).

• Des Data Owners définissent un cadre sur leur périmètre de données critiques, à savoir : définition de la donnée, niveaux d’exigences de qualité, méthodes de vérifications… Ces Data Owners sont avant tout des opérationnels métier, experts sur leur périmètre de données, mais qui ne font pas partie de la Direction Data : par exemple un trader dressera la liste des données de marché essentielles et définira des critères de qualité de donnée. La Direction Data devra garantir la qualité selon ces critères ainsi que leur disponibilité, avec par exemple l’utilisation des bons Data Providers, le branchement des canaux, la mise en place de contrôle qualité et le calcul de KQIs (Key Quality Indicators).

• La Direction Data est le gardien du temple des bonnes pratiques Data dont les bénéfices sont davantage perçus à moyen/long terme : pilotage des coûts, unicité de la donnée, arbitrage de projets générant de la dette technique sur le Legacy… (cf. autres exemples, schéma 6).

Afin d’assurer le bon déploiement de cette organisation, Bénédicte Planes, responsable Data Gouvernance chez Bpifrance, nous explique qu’une communauté regroupant l’ensemble des acteurs Data de la banque a été créée. Ces acteurs sont appelés les Data Citizens.

Au sein de la Direction Groupe du Contrôle Permanent de la Société Générale, la transformation Data a pu se faire grâce à une impulsion en Central : l’implémentation d’un nouveau référentiel unique de gestion des risques opérationnels. Le référentiel APRC, Activités x Process x Risques x Contrôles, cartographie de façon assez complète l’ensemble des activités en les reliant aux process, puis reliant les process aux risques qu’ils comportent et enfin, reliant les risques aux contrôles qui permettent de les couvrir. Un tel référentiel implémenté dans le SI de façon Data Centric permet d’évaluer en quasi temps réel le niveau risque de chacune des activités, la protection de la banque contre ces risques et enfin les contrôles à déployer afin de parfaire le dispositif de contrôle interne. L’APRC est aujourd’hui opérationnel et Fabien Schricke nous confirme que cela constitue une véritable avancée pour la construction des plans de contrôle annuels ainsi que pour le bon déroulé des missions de contrôle.

Un cas d’actualité en synthèse

Un cas d’actualité chez Bpifrance procure une vision concrète des problématiques Data abordées et reflète la situation actuelle en gestion des risques.

L’application de moratoires « Covid » en 2020 a permis à des entreprises touchées par la crise de la Covid de bénéficier de reports d’échéances de 6 à 12 mois.

Ce contexte a présenté un double enjeu :

– une gestion de crise pour soutenir en urgence l’économie française, vocation première de Bpifrance ;

– l’évaluation des risques et la production de reporting spécifiques demandés par l’État et la BCE. Durant cette période, Bpifrance a dû prendre des risques plus importants pour accomplir sa mission, cela de façon maitrisée. Cette situation a dû être gérée à budget et à effectifs quasi constant et avec des travaux déjà planifiés à mener en parallèle.

Dans le même temps, la mise en application de la réglementation NDoD (New Definition of Default) a été maintenue par la BCE au 1er janvier 2021. NDoD rallonge la durée du défaut des entreprises dans certaines situations (notamment dans les cas de restructuration financière ou d’impayés de plus de 90 jours). Cela fait craindre une hausse des crédits dits « non performants » (NPE) du fait de sa combinaison avec la crise de la Covid-19. La nécessité du suivi rapproché du portefeuille de crédit en est renforcée.

Nous voyons toute la valeur que présentent les nouveaux outils Data dans ce contexte économique et financier complexe : les Data Lakes et Data Lineage pour la mise à disposition de données historisées de qualité, la modélisation et l'agrégation de données pour répondre à des besoins de rapports spécifiques et enfin, Data Visualisation pour synthétiser des analyses complexes.

Surtout, ce dont a besoin une Direction des risques aujourd’hui, selon Gilles Penne, responsable du domaine Normes et projets réglementaires et Pilotage des données risques chez Bpifrance, est l’autonomie et la rapidité d’accès aux données : toutes les semaines de nouvelles problématiques apparaissent et les demandes ad-hoc des régulateurs ne cessent pas.

Conclusion

En plein cœur de la transformation Data, les banques voient certaines innovations commencer à porter leurs fruits. Cependant, la transformation du SI est complexe et les directions des risques peuvent être encore réservées quant aux résultats. Le pilotage de la transformation Data se joue sur deux aspects essentiels pour les banques :

– l’écoute de la Direction des risques et de ses besoins prioritaires ;

– la connaissance de son SI et des nouvelles technologies qu’elles emploient, afin d’estimer au plus près la complexité d’un projet avant de le lancer.

C’est ainsi que la valeur métier pourra être livrée progressivement, avec agilité.