Selon vous, la méthode LDA (Loss Distribution Approach) utilisée jusqu’à présent dans la gestion des grands risques opérationnels n’est pas adaptée aux risques opérationnels extrêmes. Pourquoi ?

Catherine Véret. L’approche LDA joue encore son rôle, mais elle n’est pas la plus appropriée selon le type de risques opérationnels auxquels on a à faire. Schématiquement, il existe deux types de risques opérationnels qu’il est important de différencier : les risques de fréquence, qui se produisent souvent, mais qui ne sont pas trop graves, et les risques de gravité qui n’arrivent pas souvent, mais dont les impacts sont majeurs. La LDA est adaptée au premier type de risques : en simplifiant, elle s’apparente à une loi normale, qui évalue correctement le risque courant mais ne parvient pas à rendre compte efficacement de la « queue de distribution » où les risques graves apparaissent.

Patrick Naim. La LDA tente en effet de découvrir les « queues de distribution » par un ajustement sur des données courantes. L’idée est, à partir d’un historique de sinistres, d’ajuster une loi qui va permettre de calculer les événements graves. Cela m’a toujours paru étonnant qu’on puisse se dire que l’information sur des sinistres extrêmes serait contenue dans des sinistres courants. Pour prendre un exemple concret, une distribution sur la profondeur à laquelle les vagues rentrent sur le rivage, ne permet pas de calculer pour autant la probabilité d’un tsunami. Les phénomènes qu’on essaie de modéliser ne sont pas équivalents : les vagues correspondent à un certain type de phénomène et le tsunami à un autre. Il n’y a aucune raison pour que la loi capture cette information.

C. V. En revanche, la LDA s’adapte mieux aux risques de crédit qui comprennent bien sûr des risques de fréquence et des risques graves, mais ces derniers, compte tenu du nombre important de clients, sont également liés à un nombre d’occurrences assez significatives. On ne rencontre donc pas tout à fait la même limite de la LDA pour les risques de crédit que pour les risques opérationnels extrêmes (et les risques systémiques) ou qu’un certain nombre de risques de marché. C’est ce que nous appris la crise récente : les modèles de marché ne fonctionnaient pas si le marché n’était pas parfait, et a fortiori en période de crise.

P. N. Le fait même d’ajuster une loi suppose d’avoir une théorie qui justifie que cette loi fonctionne. Or, en risques opérationnels, nous n’avons aucune théorie qui dirait que la loi est gaussienne, normale, voire une loi de Gumbel utilisée en théorie des valeurs extrêmes. Cette tendance qui existe en finance à ajuster des lois remonte certainement à Bachelier qui a démontré, pour les risques de marché, que les rendements suivaient une loi normale à condition que les marchés soient efficients… mais il n’a pas dit que les marchés étaient efficients ! Et en risques opérationnels, il n’y a rien de tel ; personne n’a démontré que les sinistres suivaient une loi normale, ni aucun autre type de loi. Nous n’avons donc pas de théorie, mais seulement une transposition qui relève du mode opératoire. C’est une extrapolation un peu hâtive d’une démarche de modélisation – qui marche bien sur les risques de marché – appliquée aux risques opérationnels. Les assureurs le savent bien quand ils travaillent sur des risques de type catastrophe naturelle : ils ne cherchent pas à ajuster des lois sur des sinistres courants pour prévoir un risque catastrophe.

Quelle est l’approche nouvelle que vous préconisez pour intégrer ces risques de gravité ?

P. N. Pour citer à nouveau Bachelier, le début de sa thèse affirme que les causes des mouvements des marchés sont tellement nombreuses qu’il ne sert à rien d’essayer de les expliquer. Faute de pouvoir faire l’analyse des causes, la seule chose possible est de modéliser statistiquement les lois de distribution. De notre point de vue de risk manager, ce n’est pas acceptable. En matière de risques opérationnels, nous estimons au contraire que ce n’est pas parce que les événements possibles sont innombrables qu’on doit renoncer à les comprendre. Il faut essayer petit à petit de défricher, de gagner de la connaissance, de réduire les risques importants identifiés.

C. V. Il est très difficile de rendre compte de cette partie des risques extrêmes car ils comprennent des aspects aléatoires. Or les réseaux bayésiens (voir Encadré 1) sont une des techniques qui permettent de bien modéliser ces derniers et de se comprendre entre spécialistes experts de la banque et spécialistes de la modélisation. C’est une conjonction :

- de la théorie des graphes qui permet de faire des schémas de causalité pour comprendre d’où viennent la probabilité et la gravité du risque, en remontant aux principaux facteurs d’origine du risque ;

- d’une transposition de ces éléments en calculs et en modélisation à partir du théorème de Bayes sur les probabilités conditionnelles (et pas seulement des probabilités individuelles par événement). Cela permet aussi de mieux rendre compte des effets de diversification des risques et de simuler les effets dominos.

Cette méthode permet-elle d’avoir une vision transversale de l’ensemble des risques pour un groupe et d’en cerner les interactions éventuelles ?

P. N. La mesure de la dépendance ou de l’indépendance, dans une méthode purement statistique, demande de disposer de données en nombre suffisant pour pouvoir les corréler entre elles. Ce qui est impossible dans le cas d’un risque extrême. En outre, les corrélations susceptibles d’être mesurées sur des données en situation normale ne sont pas forcément valables en situation de crise. Aujourd’hui, dans toutes les réglementations (Bâle, Solvency), la question de la corrélation est problématique : il s’agit souvent de corrélations forfaitaires.

Dans notre approche, nous avons des modèles avec des causalités : s’il y a des corrélations, nous les évaluerons en regardant tout simplement les modèles et il sera possible de dire quel est le niveau de corrélation qui résulte de ce modèle, corrélations de causes et/ou de conséquences. De fait, en travaillant ainsi, nous sommes à même d’établir des corrélations statistiques sérieuses acceptables par les autorités de régulation.

C. V. Cette vision transversale des risques concerne, selon Bâle, l’effet de diversification. Certains risques sont effectivement indépendants les uns des autres : par exemple, la crue centennale à Paris et une fraude à Marseille ; d’autres sont plus ou moins dépendants : une grippe aviaire avec beaucoup de personnels absents peut entraîner un risque accru de fraude. Un lien peut aussi être établi entre le risque informatique et l’efficacité des métiers. Les analyses de causalité menées en amont via l’analyse des graphes permettent de ne pas additionner les risques quand ils ne sont pas dépendants et de mesurer les facteurs systémiques qui entraînent des réactions en chaîne.

Comment se déroule cette méthode sur le terrain ?

C. V. Notre raisonnement est fondé sur une acquisition de connaissances des activités de l’entreprise et de leurs risques. C’est en cela qu’il s’agit vraiment de risk management, comme le demande Bâle. Ce « cercle vertueux » consiste à identifier, évaluer mais aussi réduire, financer et piloter les risques. Cette phase, dite de « cartographie » des risques, est purement qualitative, liée au jugement des personnes, associée à un scoring, c’est-à-dire des notations de risque en fréquence et en gravité avec les experts et les risk managers… Nous obtenons ainsi un premier panorama global.

Puis en déterminant les causes des risques, nous identifions aussi les facteurs pour les réduire. Les risques sont réduits en fréquence par du contrôle, de l’automatisation, de la formation… Ils sont réduits en gravité, par une gestion de crise et des plans de continuité d’activité (PCA). Ensuite, cela permet aussi d’évaluer les risques résiduels et de choisir leur mode de financement (rétention, provision, assurance, fonds propres…). Dans une approche LDA fondée sur un historique de sinistres, une mesure de réduction des risques se traduit dans les séries statistiques par un ajustement théorique global. Mais elle est difficile à relier avec les actions de terrain ; alors qu’en raisonnant sur des scénarios modélisés, les mesures de réduction des risques sont explicitées dans les modèles à travers leurs paramètres, qui sont les indicateurs de risques par définition.

La clé du bon fonctionnement de ce dispositif est la méthode d’acquisition des connaissances. Il faut franchir toutes les étapes et bien cibler la maille d’analyse, en liaison avec les experts des métiers considérés pour positionner l’analyse de risques en réconciliant le top down et le bottom up. C’est très important.

P. N. Concrètement, le risk manager et le modélisateur commencent à travailler avec des experts sur des scénarios. Cela se fait au cours de réunions de travail où chacun discute de façon plutôt informelle de son métier, des risques attachés… Le travail du modélisateur à partir de ces échanges est de construire un scénario formalisé dans un « document de transposition », qui a deux avantages : d’abord, il est écrit en français, donc les experts peuvent le relire et le valider ; ensuite, il est constitué d’équations à destination du modélisateur qui peut créer sur cette base des modèles sans se poser plus de question. C’est un document structuré.

Nous avons déposé cette démarche sous forme d’un « contrat de connaissance des risques » que nous utilisons également dans l’industrie. Il comporte cette notion de pivot qui « fixe » en quelque sorte la connaissance à ce jour des risques, telle que constatée et validée par les deux parties, experts métiers et modélisateurs.

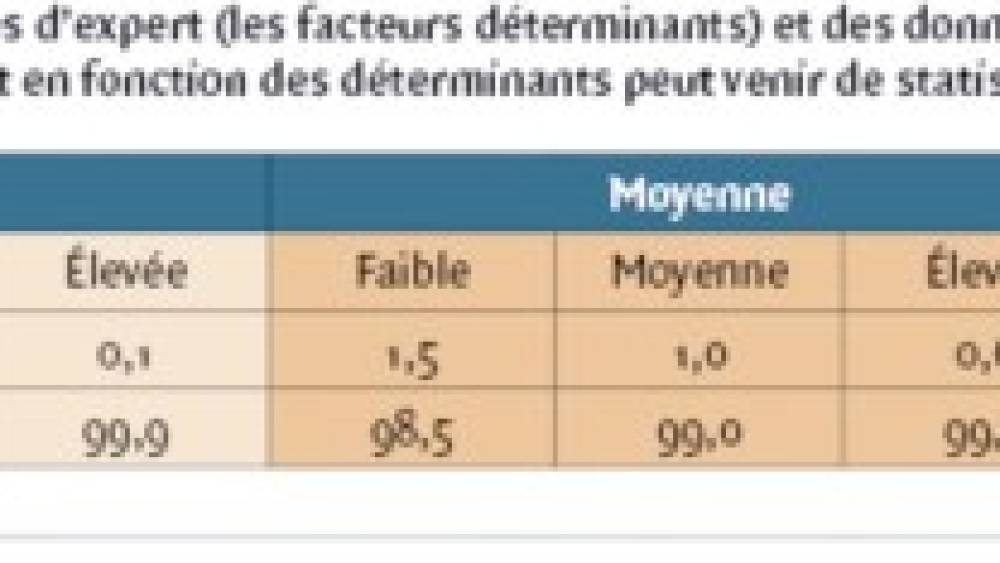

Suit un travail de quantification sur la base des facteurs qui ont été identifiés lors de la réunion et qui doit être mené par des experts, en interne et en externe. Cette quantification est parfaitement guidée car on connaît la structure du modèle.

Comment intégrez-vous l’évolution de la connaissance des risques ?

C. V. Nous avons fixé des critères pour la revoir : par exemple, si l’activité se trouve modifiée par l’occurrence d’événements extérieurs, dans son périmètre par une croissance externe, par une nouvelle réglementation…. De manière générale, une revue périodique annuelle ou pluriannuelle est nécessaire.

Pour les risques de gravité, dont l’occurrence reste très rare, les experts métiers n’ont sans doute que très peu de connaissance à partager ?

C. V. Comme Bâle le demande, sur les risques de gravité, nous ne regardons pas seulement ce qui s’est produit dans l’établissement, mais dans l’ensemble du monde. Il existe des bases de données de pertes extrêmes qui permettent d’avoir une vue sur tout ce qui s’est passé dans les 15 à 20 dernières années et nous devons dérouler la réflexion de façon à se demander : est-ce que cela pourrait nous arriver et dans quelles conditions, en fonction de la taille de notre activité, de notre niveau de contrôle, etc ?

Qui gère ces bases de données ?

C. V. Ce sont des organismes privés. Mais on pourrait imaginer que la Banque de France, l’ACP, voire une instance européenne prennent en charge la gestion d’une base de ce type. La règle est de n’y intégrer que les données publiques, ce qui entraîne parfois des difficultés pour arriver jusqu’au bout des scénarios. Ensuite, il faut réfléchir sur ses activités et de faire œuvre d’imagination pour essayer d’anticiper le pire.. et de le prévenir.

Quelle expérience avez-vous de la mise en œuvre de cette méthode ?

P. N. Nous avons mis ce système de manière généralisée dans un seul établissement mais de nombreuses expériences sur des domaines spécifiques ont eu lieu ou sont en cours dans des établissements bancaires, des établissements au service des banques ou chez des industriels. Plus de 200 modèles tournent chez nos clients (voir Encadré 2).

C. V. Ce dispositif de gestion des risques opérationnels a été implanté dans une grande banque française. Il a fallu 5 ans pour mettre en place la démarche. Tous les métiers ont été concernés.

La première étape a consisté à créer la fonction risk management, fixer les règles de gouvernance, définir les référentiels et les méthodes et former les équipes. Puis des cartographies de l’ensemble des métiers ont été établies ainsi qu’un scorecard pour noter les risques et distinguer les risques fréquence des risques gravité. Les premiers ont continué à être gérés grâce à la méthode LDA ; les seconds ont été pris en charge selon la méthode décrite, par les experts en modélisation. Parallèlement, des actions d’atténuation des risques ont été menées telles que des formations, des modifications des organisations, des augmentations des contrôles, la mise en place de PCA. Dans la chaîne de causalité, les paramètres des modèles vont être par construction les leviers de l’action de réduction : par exemple les fraudes sont d’abord liées aux personnes qui ont accès aux activités ; donc le nombre de personnes qui ont accès à telle ou telle information est un élément majeur pour évaluer la fréquence du risque de fraude. Ces critères sont d’autant mieux identifiés que les modèles ont été bien construits, avec les paramètres les plus pertinents. De facto, le risque diminue quand des actions de réduction sont mises en place et les valeurs des paramètres sont alors actualisées dans les évaluations.

Ce process a été mis en œuvre systématiquement sur toutes les activités et les risques graves, à l’exception des risques de réputation et stratégiques, ont tous fait l’objet de modélisations. Une soixantaine de scénarios ont ainsi été établis selon des approches transversales pour certains d’entre eux, par exemple pour les scénarios de fraude, de risque juridique ou de risque informatique. Ce caractère transversal veut dire que le déroulement d’un risque et ses origines ne dépendent pas du métier : par exemple le risque de responsabilité civile, de défaut de vigilance sur une fraude ou sur les moyens de paiement, les défauts de conseil fonctionnent toujours de la même manière quel que soit le métier. Par contre, la gravité peut être plus ou moins importante : pour un gestionnaire d'actifs, le défaut de conseil sera primordial ; mais le scénario initial est le même, seuls les paramètres sont pondérés différemment.

Comment s’est déroulée la validation de ces modèles auprès de l’ACP ?

C. V. Dès le début, le régulateur a reconnu que la distinction entre risques de fréquence et de gravité était pertinente. En revanche, le domaine étant nouveau, il a beaucoup mis l’accent sur l’approche prudentielle en vérifiant la robustesse du dispositif par des stress tests, des études de sensibilité et du back-testing. Il a également insisté sur la documentation à fournir pour assurer la pérennité de cette démarche, qui inclut le contrat de connaissance, le référentiel, les cartographies, le document de transposition, la piste d’audit documentée sur les données et les résultats ainsi que la possibilité de rejouer les résultats avec l’outil. L’accent a été mis aussi, bien sûr, sur les procédures générales et la gouvernance du dispositif.

Cette méthode peut-elle être élargie à d’autres types d’activités ?

P. N. Elle peut être élargie à d’autres activités sur le même type de risques extrêmes, par exemple dans le domaine de l’assurance avec Solvency II (voir Encadré 3). En effet,

Enfin cette méthode peut être utilisée pour les stress tests, ou pour l’analyse des risques systémiques. Une telle démarche est conforme avec les recommandations du comité de Bâle sur les bonnes pratiques en matière de stress tests, et notamment une plus grande prise en compte de