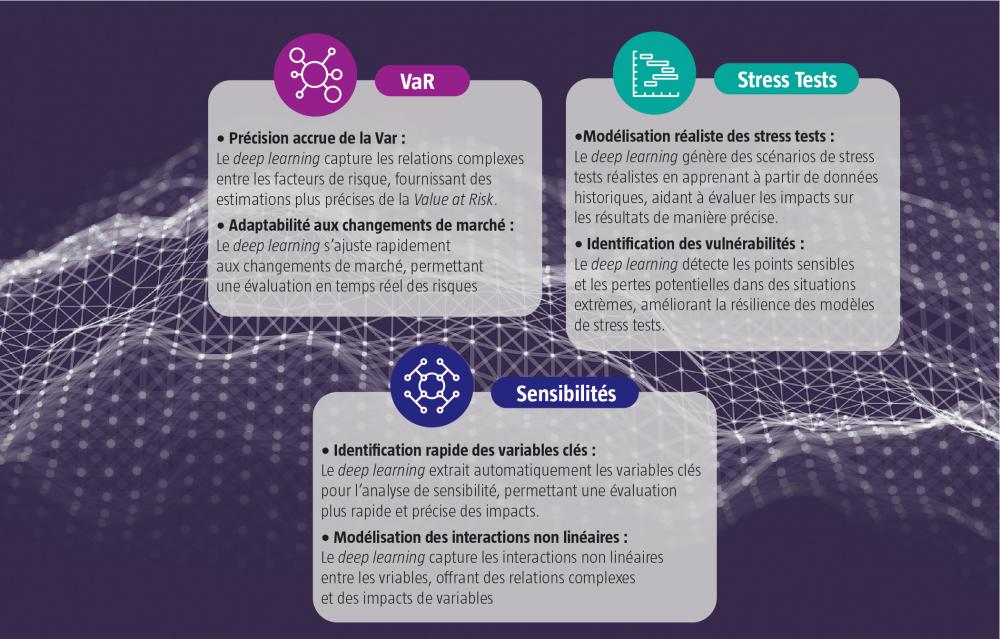

L’intelligence artificielle (IA) bouleverse l’ensemble des secteurs économiques et particulièrement le secteur financier. Une rétrospective de l’utilisation du deep learning dans la modélisation des risques de marché, avec ses échecs et ses succès, fait apparaître ses contraintes mais aussi ses forces, déterminant ses évolutions actuelles et les défis des années à venir. Les risques de marché peuvent être définis comme les risques liés aux fluctuations des prix des actifs financiers. Ces fluctuations peuvent être causées par des facteurs économiques, politiques et des facteurs géopolitiques.

Tout d’abord, il convient de définir ce qu’est le deep learning ou « apprentissage profond ». C’est un type d’intelligence artificielle, dérivé du machine learning, où la machine est capable d’apprendre par elle-même, contrairement à la programmation où elle exécute à la lettre des règles prédéterminées. Le deep learning s’appuie sur un réseau de neurones s’inspirant du cerveau humain. Il est composé de dizaines, voire de centaines de « couches » de neurones, chacune recevant et interprétant les informations de la couche précédente. Le deep learning permet de capturer des relations complexes et non linéaires entre les variables d’entrée (ce qui le rend potentiellement très utile pour la modélisation des risques de marché).

Dans les années 2010, l’histoire du deep learning a été jalonnée de difficultés. En 2012, JPMorgan Chase a subi une perte de 6 milliards de dollars en raison d’une stratégie de trading automatisée qui utilisait des algorithmes basés sur des réseaux de neurones. Elle a été attribuée à des erreurs de modélisation des risques. La perte est survenue en raison d’un manque de supervision et de contrôle des algorithmes utilisés. Ce cas illustre l’importance de la gouvernance d’un dispositif automatisé de risk management.

En 2016, la banque néerlandaise ING a mis fin à un projet de modélisation des risques de crédit basé sur des réseaux de neurones en raison de résultats insuffisamment précis ; la précision insuffisante du modèle était liée au manque de données disponibles pour l’entraîner. Ce cas illustre une difficulté couramment rencontrée par les pionniers du deep learning : il requiert de très grandes quantités de données pour être performant.

Plus récemment, grâce à l’effet combiné de l’évolution des outils informatiques et des progrès de la R & D en deep learning appliquée au risk management, des projets ont été couronnés de succès.

En 2019, Morgan Stanley1 a développé un modèle de prédiction de la volatilité du marché utilisant un réseau de neurones convolutifs, qui a montré une précision accrue par rapport aux modèles traditionnels, en prenant en compte des données de marché non linéaires et des facteurs de marché tels que la liquidité et la volatilité historique.

En 2021, Bank of America a annoncé qu’elle avait développé un modèle basé sur le deep learning pour prédire les fluctuations de taux d’intérêt, pour analyser les données macroéconomiques et de marché et prédire les taux d’intérêt à court et à long terme. Selon Bank of America, ce modèle a montré de meilleures performances en termes de précision accrue par rapport aux modèles traditionnels2. La même année, Wells Fargo a annoncé qu’elle avait développé un modèle basé sur le deep learning pour prédire les prix des matières premières. Les réseaux de neurones analysaient les données de marché et les tendances historiques afin de prédire les prix futurs. Selon Wells Fargo là encore, ce modèle a montré une précision accrue par rapport aux modèles traditionnels. Deutsche Bank3, enfin, a annoncé avoir développé un modèle basé sur le deep learning pour prédire les fluctuations des taux de change. En analysant les données macroéconomiques et de marché, l’objectif était de prédire les taux de change à court et à long termes. Selon Deutsche Bank, les résultats obtenus se sont avérés plus précis qu’avec des modèles traditionnels.

Des modèles perfectibles

Nous sommes encore au balbutiement de cette technologie, les perspectives du deep learning dans la modélisation des risques de marché restent indéniablement très encourageantes car les progrès en IA (outils et recherche) sont extrêmement rapides.

La principale difficulté actuelle concernant le deep learning dans la modélisation des risques de marché est l’interprétabilité des résultats, soit l’effet « Black Box ». En effet, leur complexité rend parfois ces modèles difficiles à interpréter, l’explication des résultats aux parties prenantes n’en est que plus délicate, limitant la confiance de ces dernières, et peut poser problème pour satisfaire aux exigences de validation interne de modèle, d’auditabilité interne et du superviseur.

Des recherches récentes se sont concentrées sur des méthodes pour améliorer la transparence des modèles de deep learning, comme la visualisation. Ainsi, la visualisation des couches cachées assortie de techniques d’attribution d’importance peut expliquer les décisions prises par le modèle.

La qualité des données est essentielle pour un apprentissage efficace. Grâce à des techniques de prétraitement des données, telles que la normalisation et la régularisation, leur qualité peut être améliorée. Avant de faire usage de ces données dans un modèle de deep learning, il est important de s’assurer qu’elles sont complètes, cohérentes et correctes. Dans certains cas, elles peuvent être déséquilibrées, c’est-à-dire que certaines classes ou catégories recèlent bien plus de données que d’autres. Cela peut entraîner un biais dans le modèle. L’équilibrage des données consiste à égaliser leur nombre pour chaque catégorie.

Enfin, la configuration de marché retenue pour l’apprentissage est un facteur clé : s’il se fait dans une période de forte hausse des prix, comment savoir si la stratégie fonctionnera lors d’une baisse de ces derniers ? Cette question se révèle bien plus complexe que lorsqu’il s’agit de méthodes traditionnelles de couverture, où le modèle qui génère les dynamiques des produits financiers est validé dans l’espace des prix. Dans l’apprentissage de stratégies de couverture, on valide le modèle implicitement contenu par les données dans l’espace des contrôles (c’est-à-dire celui des stratégies de couvertures apprises)4.

Un autre écueil possible concerne la prise en compte d’évènement extrême (ex : une baisse des prix prolongée) au cours duquel l’algorithme est susceptible de continuer d’augmenter une position car il détecte une opportunité (de couverture par exemple). Ce type de cas nécessite un traitement particulier. Nous avons également découvert dans nos recherches en IA5 que, même au sein d’une classe d’actifs homogènes (les actions par exemple), les comportements varient fortement et qu’un seul modèle ne peut pas capter correctement le comportement idiosyncratique des actifs.

Les outils de l’avenir

Le deep hedging6 est une méthode de couverture des risques financiers qui utilise des algorithmes basés sur le deep learning pour optimiser la gestion des portefeuilles de couverture. Cette méthode a été développée pour que les investisseurs se protègent contre les risques de marché tout en maximisant les rendements de leur portefeuille. Le deep hedging se sert des modèles de réseau de neurones dans l’objectif de prédire les mouvements de prix futurs des actifs sous-jacents et d’évaluer les risques associés à ces mouvements. Les modèles sont entraînés sur des données historiques de marché pour apprendre les corrélations entre différents actifs et les effets de divers facteurs macroéconomiques sur les prix. Grâce à ces modèles, les gestionnaires peuvent concevoir des stratégies de couverture dynamiques qui s’adaptent aux fluctuations des prix du marché en temps réel. Les décisions de couverture sont prises automatiquement par les algorithmes en fonction des signaux de marché, ce qui réduit les coûts de transaction et améliore l’efficacité de la couverture.

Le deep hedging est une méthode relativement nouvelle et il y a encore beaucoup de recherches en cours pour en explorer les possibilités. Cependant, cette méthode montre un grand potentiel pour améliorer la gestion des risques de marché et permettre aux investisseurs de mieux se protéger contre les fluctuations des marchés.

De nouvelles architectures de réseaux de neurones sont constamment développées pour améliorer les performances du deep learning, telles que les réseaux de neurones récurrents (RNN) et les réseaux de neurones convolutifs (CNN). Ces architectures donnent la possibilité d’aborder des problèmes de modélisation de données complexes, via des techniques telles que l’apprentissage par renforcement et la génération de données synthétiques.

Enfin, un axe de développement intéressant est celui de l’apprentissage par renforcement, ou reinforcement learning, pour la gestion des risques. Cette technique d’apprentissage automatique de prise de décision en interagissant avec son environnement pourrait servir à optimiser les décisions de gestion de portefeuille en fonction des risques de marché.

Pour conclure, les pistes d’amélioration sont nombreuses et les progrès vont à grand pas. Il n’est pas impossible que, dans une dizaine d’années, les modèles et outils actuels soient remplacés par ces technologies. Les enjeux en termes de gouvernance et de politique de gestion des risques seront au cœur de ces évolutions.