Le volet quantitatif du dispositif prudentiel Solvabilité 2 fixe comme règle de détermination du capital de solvabilité requis (SCR) le contrôle de la probabilité de ruine à un an, qui doit être inférieure ou égale à 0,5 % (c’est-à-dire, en première approche, une faillite tous les 200 ans au plus

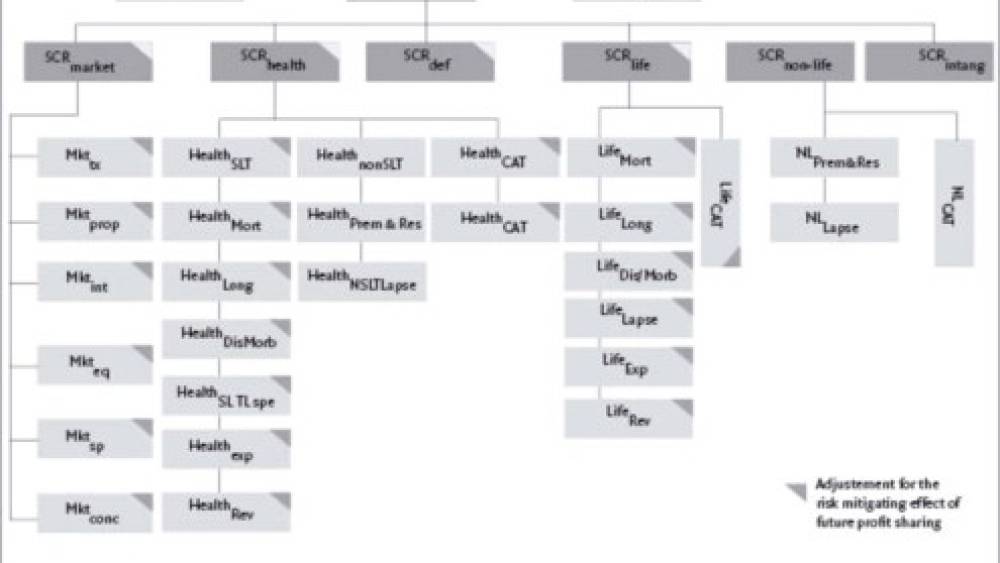

Dès lors, un modèle de calcul du SCR devra prendre en compte chacun des risques identifiés dans cette grille, en proposer une modélisation en référence à un événement adverse bicentenaire et décrire la manière d’agréger les capitaux unitaires ainsi obtenus.

Afin de rendre le dispositif accessible à l’ensemble des organismes d’assurance et de fixer un référentiel commun, Solvabilité 2 propose un « modèle standard » qui s’attache à modéliser le besoin en capital associé à chacun des items de la grille et à en déduire le niveau global de capital de solvabilité. La logique générale de ce modèle est simple : pour chaque module de risque, le modèle décrit les caractéristiques d’un choc bicentenaire à appliquer à la variable considérée. La variation de la marge actif / passif (net asset value) est alors mesurée, ce qui fournit une évaluation du besoin en capital. Dans un second temps, ces capitaux de base sont agrégés en s’attachant à tenir compte des interactions entre les différentes sources de risque.

On peut observer que le recours à des scénarios de stress n’est pas une novation de Solvabilité 2 et que la réglementation prudentielle actuelle des assurances y a également recours, tant à l’actif (avec l’état T3 et le test d’exigibilité prévus aux articles R. 332-1-2 et R. 344-4 du Code des assurances) qu’au passif (au travers notamment des états C8 et C9 relatifs au dispositif de réassurance). Toutefois, le nouveau référentiel systématise cette approche et en fait la technique de référence pour la détermination du niveau du capital.

Cette logique nécessite in fine d’appréhender deux éléments : le calibrage du choc unitaire et le processus d’agrégation des capitaux.

Le calibrage du choc individuel : un choix d’intensité sous contrainte

Si le principe de prise en compte d’un choc est simple, la détermination de son niveau est en pratique une tâche complexe qui peut nécessiter des analyses préalables conséquentes.

En pratique, le niveau des chocs est fixé dans un certain nombre de cas avec une part d’arbitraire.

Considérons à titre d’exemple le risque de marché associé à la détention d’actions. Il est mesuré dans le modèle standard en faisant subir à la valeur de l’exposition « actions » une chute de 30 % en 2009 (le ratio dépend de l’exercice et du niveau des marchés d’actions par rapport à leur tendance estimée de long terme). On considère donc que dans les conditions de marché 2009, la chute des actions sera de plus de 30 % une fois tous les 200 ans. On pressent déjà au travers de cet exemple très simple que le choix de l’intensité du choc est le plus souvent le résultat d’un compromis entre une analyse que l’on peut qualifier de probabiliste du phénomène et d’une opinion de place sur la pertinence du niveau retenu. Ainsi, en l’espèce, le quantile à 0,5 % de la distribution du rendement des actions est très variable en fonction des données retenues, du modèle et de la profondeur de l’historique. Quoi qu’il en soit, le niveau de 30 % apparaît en deçà des résultats obtenus à partir d’une analyse des propriétés statistiques des séries historiques. On le voit, ici, ce sont au moins autant des difficultés techniques que des considérations économiques qui conduisent à positionner le niveau finalement retenu.

D’autres situations sont techniquement plus délicates. Dans le cas par exemple du risque catastrophique pour des garanties d’assurance vie, le modèle standard fixe comme référence un taux de décès additionnel de 0,15 %. Ce calibrage est justifié par des études sur les pandémies grippales et les nombreux travaux menés sur ce sujet

In fine, le choix du calibrage des chocs individuels dans le modèle Solvabilité 2 a dérivé d’une approche théorique vers une démarche plus empirique, intégrant les contraintes économiques et d’opportunité, ce qui est logique, mais n’est pas nécessairement strictement équivalent à la démarche initialement énoncée.

De ce point de vue, on peut observer que les états réglementaires C8 et C9, en distinguant explicitement l’épidémie et l’accident technologique, permettent une analyse plus fine du risque catastrophique porté par un assureur. Incidemment, dans ce dernier cas de figure, on ne cherche pas à évaluer la probabilité de survenance associée à l’événement, mais on se place plutôt dans le contexte de survenance du « sinistre maximum possible ».

Le processus d’agrégation des capitaux : des logiques d’interaction pas toujours évidentes

On l’a vu, la détermination du niveau des chocs applicables à chaque module est délicate. Une fois cette étape franchie, il reste à combiner ces risques unitaires pour obtenir le niveau de capital global à allouer. Cela nécessite pratiquement de poser une hypothèse sur la structure de dépendance entre les différents facteurs de risque intégrés au modèle pour en déduire des formules d’agrégation, qui techniquement reviennent à calculer le quantile à 99,5 % d’une somme de variables aléatoires non indépendantes.

En première approche on peut retenir que le modèle standard utilise une structure gaussienne, qui présente l’avantage de permettre de résumer le niveau de dépendance entre différents facteurs par une simple matrice de corrélation. Toutefois, cette structure n’est pas décrite directement au niveau des facteurs de risque sous-jacents, mais au niveau des capitaux requis pour couvrir chaque facteur de risque pris isolément. Ce choix permet de calculer les capitaux agrégés par de simples formules de la forme, mais présente un inconvénient majeur : les coefficients sont inobservables. L’exemple de l’interaction actions-obligations démontre ce fait, quand bien même le sujet est étudié par le marché de la finance depuis des décennies les valeurs des coefficients de corrélation apparaissent instables, en particulier dans les situations extrêmes qui intéressent le modèle Solvabilité 2. Elles ont d’ailleurs changé entre les tests QIS4 (avant la crise financière de 2008) et QIS5. En effet, ils ne mesurent pas le degré de dépendance entre les facteurs de risque, mais entre les capitaux marginaux pour les couvrir. De ce fait, le calibrage de ces coefficients est arbitraire et quand bien même le niveau de 0,5 % est respecté au niveau de chaque risque marginal, il ne l’est plus globalement. On peut ici remarquer que le Swiss Solvency Test (SST) a retenu sur ce point une logique différente en positionnant la structure de dépendance au niveau des facteurs de risque.

On retrouve ici un autre type de choix marqué par le souci de la simplicité voire l’opportunité qui paraît logique, mais ne garantit pas le respect de la règle des seuils à 0,5 %

Un modèle cohérent ?

Le modèle standard de Solvabilité 2 fournit un exemple d’un dispositif de détermination du capital de solvabilité essentiellement basé sur une logique de stress tests, avec la volonté de fixer l’intensité du stress de manière à caractériser une situation survenant une fois tous les ans. Cette logique est valable aussi bien dans le cadre du modèle standard que dans un éventuel modèle interne partiel ou global.

On peut toutefois retenir deux limites importantes dans le cadre d’un modèle dont l’ambition est de contrôler la probabilité de ruine à un an :

– la quantification du choc bicentenaire unitaire pour chaque source de risque n’est pas simple à calculer et dépend dans le cas général des caractéristiques propres du portefeuille de l’assureur ;

– l’agrégation des capitaux unitaires impose de devoir prendre en compte les interactions entre les sources de risque, ce qui est en pratique une étape très délicate, tant du point de vue de la modélisation que de sa mise en œuvre numérique.

De fait, rien ne permet d’affirmer que le niveau de l’exigence de capital issu de l’application du modèle standard de Solvabilité 2 soit en phase avec l’objectif de limiter la probabilité de ruine à un an au seuil de 0,5 %, ce qui peut apparaître paradoxal.

Les logiques de stress apparaissent ainsi bien adaptées à l’appréciation des conséquences d’un événement bien défini, indépendamment de sa probabilité d’occurrence, mais s’avèrent difficiles à transposer dans un cadre où les scénarios se voient probabilisés et considérés de manière conjointe.

Dans ce dernier cas, il peut s’avérer plus logique, mais délicat à mettre en place une approche intégrée fondée sur la modélisation conjointe des différentes sources de risque pour mesurer ex post le quantile à 99,5 % produit par un modèle, certes nécessairement imparfait, mais certainement cohérent.